生成式 AI (Generative AI) 是个人计算史上最重要的趋势之一,推动游戏、创作、视频编辑、日常工作、开发等的发展。

GeForce RTX 和 NVIDIA RTX GPU 配备名为 Tensor Cores 的专用 AI 处理器,将生成式 AI (Generative AI)的强大功能原生引入超过 1 亿台 Windows PC 和工作站。

如今,TensorRT-LLM for Windows 使PC 生成式AI (Generative AI) 速度提高 4 倍,TensorRT-LLM for Windows 是一个开源库,可加速最新 AI 大语言模型 (如 Llama 2 和 Code Llama) 的推理性能。此前,TensorRT-LLM for Datacenter 已在上个月发布。

NVIDIA 还发布帮助开发者加速 LLM 的工具,包括使用 TensorRT-LLM 优化自定义模型的脚本、TensorRT 优化的开源模型,以及一个展示 LLM 响应速度和质量的开发者参考项目。

TensorRT 加速现已应用于 Automatic 1111 发布的热门应用 Stable Diffusion WebUI。它将生成式 AI(Generative AI)扩散模型的速度提升 2 倍,比此前最快的速度还快。

此外,作为今天发布的 Game Ready 驱动的一部分,RTX VSR 视频超分辨率(Video Super Resolution) v1.5 版现已发布,11月初发布的 NVIDIA Studio 驱动也将支持该技术。

TensorRT 为 LLM 增效

LLM 正在提高生产力——聊天、总结文档和网页内容、起草电子邮件和博客,并且是由 AI 和其他软件所组成的全新工作流的核心,可以自动分析数据并生成大量内容。

TensorRT-LLM 是 NVIDIA 用于加速 LLM 推理的库,使开发者和最终用户可以享受运行 LLM 的更多优势。现在,LLM 在搭载 RTX 的 Windows PC 上的运行速度可提高 4 倍。

在更大的批量大小下,这种加速可显著改善更复杂的 LLM 使用体验,如写作和编码助手,可同时输出多个唯一的自动完成结果,从而加速性能并改进质量,让用户可以有最好的选择。

TensorRT-LLM 加速还有利于将 LLM 功能与其他技术相结合,例如在检索增强生成 (RAG) 中,LLM 与向量库或向量数据库组合。RAG 使 LLM 能根据特定的数据集 (如用户的电子邮件或网站文章) 提供更有针对性的答案。

在实际应用中,当我们向 LLaMa 2 基础模型提出“《心灵杀手2》(Alan Wake 2) 集成了 NVIDIA 的哪些技术?”这一问题时,它给出“游戏尚未公布”这一毫无帮助的回答。

相反,使用 RAG 将 GeForce 新闻添加到向量库中,并连接到相同的 Llama2 模型,不仅得到正确答案——NVIDIA DLSS 3.5、NVIDIA Reflex 和全景光线追踪,而且在 TensorRT-LLM 加速的助力下响应速度更快。这种速度与能力的结合为用户提供更智能的解决方案。

TensorRT-LLM 即将能从 NVIDIA 开发者网站下载。

TensorRT 优化的开源模型和以 GeForce 新闻为示例项目的 RAG Demo 可从 ngc.nvidia.com和 GitHub.com/NVIDIA下载。

自动加速

Diffusion 模型 (如 Stable Diffusion) 用于想象和创造令人惊叹的新颖艺术作品。图像生成是一个迭代过程,可能需要数百次循环才能获得完美输出。如果在性能不足的 PC 上进行,这种循环可能会增加数小时的等待时间。

TensorRT 旨在通过神经网络层融合、精度校准、内核自动选择和其他功能加速AI模型,从而显著提高推理效率和速度。这使它成为实时应用和资源密集型任务不可或缺的工具。

现在,TensorRT 使 Stable Diffusion 生成速度翻倍。

兼容最热门的 Automatic1111 WebUI,借助 TensorRT 加速 的 Stable Diffusion 可以帮助用户加快迭代速度,减少 PC 等待时间,更快生成最终图像。在 GeForce RTX 4090 上,它的运行速度是使用苹果 M2 Ultra 的 Mac 顶配版的 7 倍。该扩展即日起可供下载。

基于 Stable Diffusion 流程的 TensorRT Demo 为开发者提供了如何为 TensorRT 加速准备扩散模型并部署加速的参考实现。这是一个起点,它可以为对此感兴趣的开发者加速 Diffusion 流程,并为应用带来快如闪电的推理能力。

超级视频体验

AI 正在改善所有用户的诸多日常 PC 体验。流媒体视频是 PC 上最受欢迎的活动之一,其来源几乎无所不包,如 YouTube、Twitch、Prime Video、Disney+ 等。得益于 AI 和 RTX,它的图像质量又有全新提升。

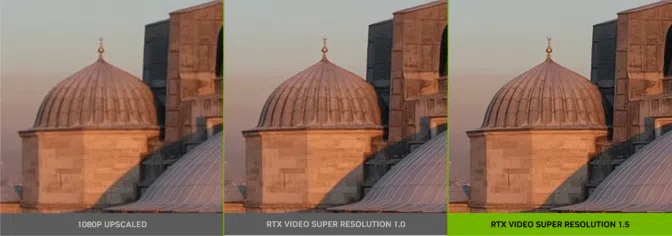

RTX VSR 视频超分辨率在 AI 像素处理方面的重大突破,通过减少或消除压缩视频造成的失真,提高直播视频内容的质量。此外,它还能锐化边缘和细节。

现在,RTX VSR 视频超分辨率 v1.5 版通过更新模型进一步提升视频画面质量,消除以原始分辨率播放内容的伪影,并增加对采用 NVIDIA Turing 架构的 RTX 20 系列 GPU的支持,包括:专业图形卡和 GeForce RTX 20 系列 GPU 。

重新训练 VSR AI 模型有助于它学会准确识别微妙细节和压缩失真之间的区别。因此,经过 AI 增强的图像在放大过程中能更准确地保留细节。细节更加清晰可见,整体图像看起来更加锐利清晰。

v1.5 版的全新功能是消除以屏幕原始分辨率播放视频时的失真。最初的版本仅在视频分辨率被提升时增强视频效果。现在,例如在 1080p 分辨率显示器上串流 1080p 视频会更流畅,因为严重的失真会显著改善。

即日起,所有 RTX 用户可在最新的 Game Ready 驱动中获取 RTX VSR 视频超分辨率 v1.5 版使用,下月初发布的 NVIDIA Studio 驱动也将支持该技术。

RTX VSR 视频超分辨率是NVIDIA软件、工具、库和 SDK (如上文提到的软件、工具、库和 SDK,以及 DLSS、Omniverse、AI Workbench等软件) 的一部分,这些软件、工具、库和 SDK 为消费者带来超过400 款 AI 加速的应用和游戏。

AI 时代即将到来。 RTX 正为其发展的每一步增加动力。