亚马逊云科技(AWS)和 NVIDIA 将为全球企业带来新一代生成式 AI 技术。

当地时间本周二,NVIDIA 创始人兼首席执行官黄仁勋与亚马逊云科技首席执行官 Adam Selipsky 同台出现在拉斯维加斯威尼斯人会展中心举行的 2023 亚马逊云科技 re:Invent 上,该大会以 AI 和云为主题。

Selipsky 表示他“非常高兴”宣布亚马逊云科技和 NVIDIA 合作关系的扩展,两家公司将提供更多的服务,为先进的图形、机器学习和生成式AI基础设施提供支持。

双方宣布,亚马逊云科技将成为率先采用最新 NVIDIA GH200 NVL32 Grace Hopper 超级芯片的云提供商,该芯片带有全新多节点 NVLink 技术;还宣布 NVIDIA DGX 云将在AWS平台上可使用;此外,宣布亚马逊云科技已经集成了 NVIDIA 最受欢迎的一些软件库。

黄仁勋首先强调了包括 NVIDIA AI Enterprise 、 cuQuantum 和 BioNeMo 在内的一系列关键 NVIDIA 软件库与亚马逊云科技的集成,以满足数据处理、量子计算、数字生物学等领域的需求。

黄仁勋表示,此次合作将推动数百万开发者和近 4 万家企业能够在亚马逊云科技平台使用这些软件库。他还表示很高兴看到亚马逊云科技扩展其云实例服务,将 NVIDIA 最新的 L4、L40S 以及即将推出的 H200 GPU 纳入其中。

Selipsky 随后介绍了首次亮相亚马逊云科技的 NVIDIA GH200 Grace Hopper 超级芯片,表示这是云计算领域的一项重大进步,并请黄仁勋进行更加详细的介绍。

黄仁勋表示:“Grace Hopper,也就是 GH200,以一种非常独特的方式连接了两款颠覆性的处理器。”他解释说,“GH200 使用名为 NVLink 的芯片到芯片互连技术,将 NVIDIA 的 Grace Arm CPU 与 H200 GPU 连接在一起,其速度惊人,可达每秒 1 TB。”

每个处理器都可以直接访问高性能的 HBM 和高效率的 LPDDR5X 内存。该配置使每个超级芯片的处理能力达到 4 PFLOPS,内存容量达到 600GB。

亚马逊云科技和 NVIDIA 用新型 NVLink 交换机来连接单个机架中的 32 个 Grace Hopper 超级芯片。每 32 个 GH200 NVLink 连接的节点都可称为是一个 Amazon EC2 实例。在与 AWS Nitro 和 EFA 网络集成后,客户就可以连接 GH200 NVL32 实例,扩展到数千颗 GH200 超级芯片。

黄仁勋表示:“通过 AWS Nitro 可以将其变成一个巨大的虚拟 GPU 实例。”

他还表示,亚马逊云科技在高度可扩展云计算领域的专业知识与 NVIDIA Grace Hopper 创新的结合,将使得这一平台为复杂的生成式 AI 工作负载带来极致性能。

在介绍亚马逊云科技上的 NVIDIA DGX 云时,Selipsky 表示:“这个基础设施真是太棒了,它还延伸到了软件、服务和所有其他内含的工作流。”

此次合作将使得首台基于 GH200 超级芯片的 DGX 云 AI 超级计算机成为可能,它将展现亚马逊云科技云基础设施和 NVIDIA AI 专业技术的强大威力。

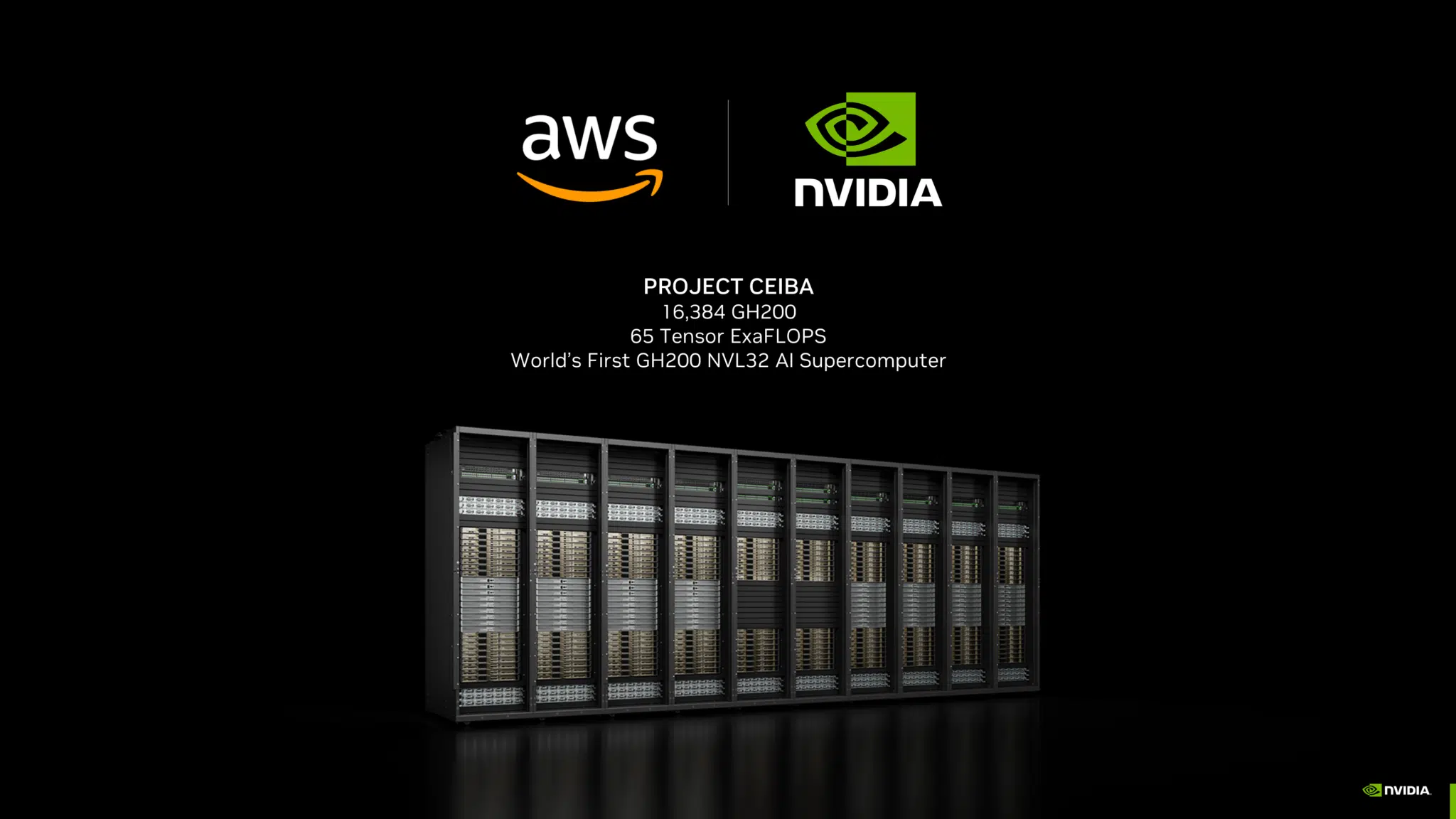

随后,黄仁勋宣布亚马逊云科技中的这台全新 DGX 云超级计算机(代号为 Project Ceiba)也将作为 NVIDIA 最新的 AI 超级计算机,用于 NVIDIA 自己的 AI 研发工作。

黄仁勋表示,以雄伟的亚马逊木棉树(Ceiba)命名的 Project Ceiba DGX 云集群将集成 16,384 个 GH200 超级芯片,可实现 65 EFLOPS 的 AI 处理性能。

他表示,Ceiba 将是全球首台 GH200 NVL32 AI 超级计算机,也是 NVIDIA DGX 云中最新的 AI 超级计算机。

他用 “难以置信” 来形容 Project Ceiba AI 超级计算机,称它能够将最复杂的大语言模型的训练时间缩短一半。

黄仁勋表示,NVIDIA 的 AI 工程师团队将在 DGX 云中使用这台全新超级计算机,以推动 AI 在图形、大语言模型、图像/视频/3D 生成、数字生物学、机器人、自动驾驶汽车、Earth-2 气候预测等领域的应用。

“DGX 是 NVIDIA 的云 AI 工厂。无论是计算机图形学、数字生物学模型的创建,还是机器人技术及气候仿真和建模,AI 如今已成为 NVIDIA 扎实自身工作的关键。”

黄仁勋还表示:“DGX 云也是我们与企业客户合作的 AI 工厂,以帮助他们一同构建自定义 AI 模型。他们负责提供数据和领域专业知识,而我们负责提供 AI 技术和基础设施。”

此外,黄仁勋还宣布,亚马逊云科技将在明年初推出四个基于 NVIDIA GH200 NVL、H200、L40S、L4 GPU 的亚马逊 EC2 实例。

在谈话的最后,Selipsky 宣布,基于 GH200 的实例和 DGX 云将于明年在亚马逊云科技上提供。