ChatGPT 仅是一个起点。

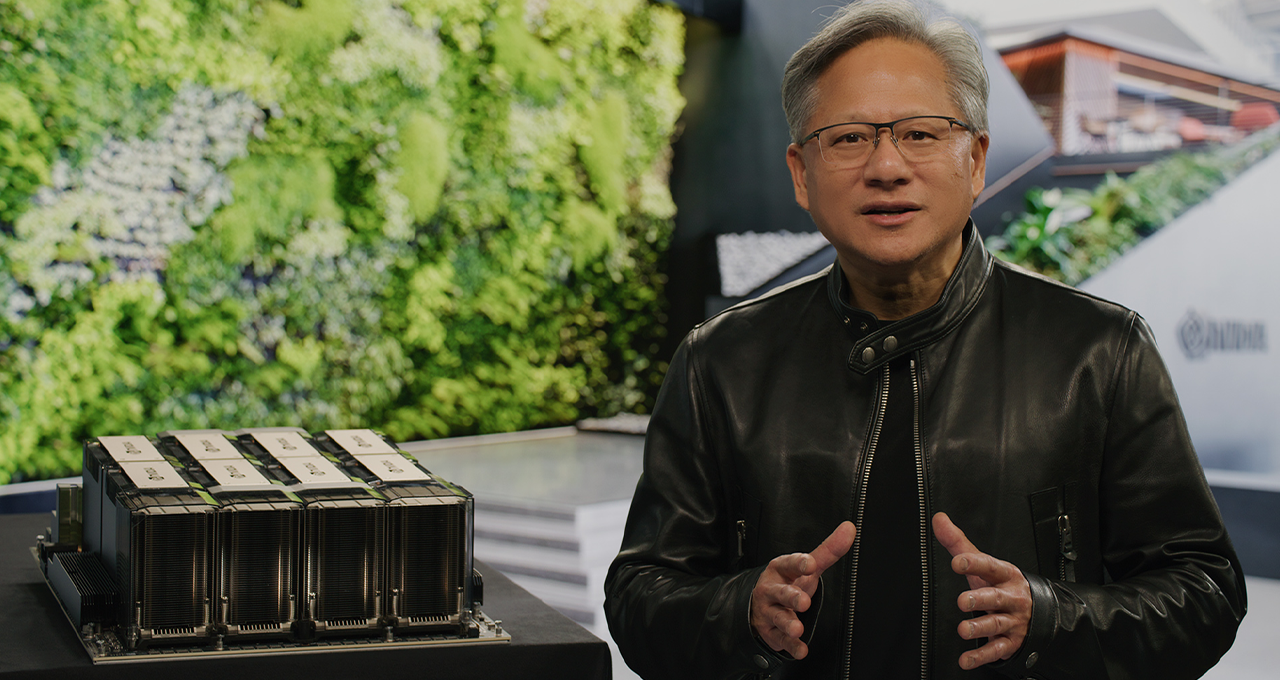

正如 NVIDIA 创始人兼首席执行官黄仁勋所说,计算正在以“光速”发展。黄仁勋于今日宣布与谷歌、微软、Oracle 等一众领军企业开展广泛的合作,为各行各业带来新的 AI、模拟和协作能力。

黄仁勋在 NVIDIA GTC 大会主题演讲中表示:“如果把加速计算比作曲速引擎,那么AI就是动力来源。生成式 AI 的非凡能力,使得公司产生了紧迫感,他们需要重新构思产品和商业模式。”

作为这场为期四天活动的主题演讲,黄仁勋在长达78分钟的演讲中概述了 NVIDIA 及其合作伙伴如何提供训练和部署尖端 AI 服务所需的各种技术。他发布了全新的半导体和软件库以推动行业新突破,以及一套完整的系统和服务,帮助各类初创公司及企业将这些创新在全球发挥作用。

黄仁勋在演讲中用生动的例子说明了该生态系统的作用。他宣布 NVIDIA 和微软将把数亿 Microsoft 365 和 Azure 用户连接到一个用于构建和操作超现实虚拟世界的平台,并介绍了亚马逊如何使用复杂的模拟能力训练新的自主仓库机器人。他还谈到 ChatGPT 等最近大火的新一代生成式 AI 服务的兴起。

在强调 NVIDIA 创新成果的基础作用时,黄仁勋详细介绍了NVIDIA 在计算光刻技术领域所取得的突破,以及与 ASML、TSMC 和 Synopsis 的合作,这些将为制造高效、强大的新一代 2 纳米半导体奠定基础。

黄仁勋表示,加速计算和 AI 的出现恰逢其时。摩尔定律正在放缓,各个行业正在应对可持续发展,生成式 AI 以及数字化等强大的动态挑战。“各个行业的企业正在竞相进行数字化转型,希望成为软件驱动的技术公司,成为行业颠覆者而不是被颠覆者。”

加速计算可助力企业应对这些挑战。黄仁勋表示:“加速是重获优势、实现可持续发展,以及达到净零排放的最佳途径。”

GTC:行业领先的 AI 大会

进入到第 14 个年头的 GTC 已成为全球最重要的 AI 大会之一。本次大会有超过 650 场会议,演讲嘉宾包括来自 DeepMind、Adobe、Netflix、苏黎世联邦理工学院等企业和机构的行业领导者,此外,本届大会还有一场黄仁勋和 OpenAI 联合创始人 Ilya Sutskever 的炉边谈话,ChatGPT 正是 OpenAI 的产品。

超过 25 万名注册用户将深入参与 GTC 各个主题的会议,其中涵盖如何修复 2000 年前失传的罗马马赛克、建造未来工厂、用新一代大型望远镜探索宇宙、通过重新排列分子加速药物研发、以及 70 多场关于生成式AI的讲座等。

AI 的 iPhone 时刻

NVIDIA 技术是 AI 的基础,黄仁勋讲述了 NVIDIA 如何在生成式 AI 变革初期就已参与进来。早在 2016 年,他就向 OpenAI 亲手交付了第一台 NVIDIA DGX AI 超级计算机——支持 ChatGPT 的大型语言模型突破背后的引擎。

去年年底推出的 ChatGPT 几乎在一夜之间爆火,吸引了超过1亿用户,成为有史以来增长最快的应用。黄仁勋认为 “我们正处于 AI 的 iPhone时刻 ”。

黄仁勋表示,最初作为AI研究仪器使用的 NVIDIA DGX 超级计算机现已在世界各地的企业中全天候运行,用于完善数据和处理 AI。《财富》100 强企业中有一半都安装了DGX AI 超级计算机。

“DGX 超级计算机是现代 AI 工厂”。

用于数据中心的 NVIDIA H100、Grace Hopper 和 Grace

黄仁勋表示,类似 ChatGPT 大型语言模型(LLM)的部署是一个重要的全新推理工作负载。为了支持像 ChatGPT 这样的大型语言模型推理,黄仁勋发布了一款新的 GPU——带有双 GPU NVLink 的 H100 NVL。

基于 NVIDIA Hopper 架构的 H100 配有一个 Transformer 引擎,旨在处理驱动 ChatGPT 的类似 GPT 模型。与用于 GPT-3 处理的 HGX A100 相比,配备四对 H100 与双 GPU NVLink 的标准服务器的速度最高可达 10 倍。

黄仁勋表示:“H100 可以将大型语言模型的处理成本降低一个数量级。”

在过去十年中,云计算每年增长 20% 并已发展成为一个万亿美元的产业。NVIDIA 为这个 AI 和云优先的世界设计了 Grace CPU,其中 AI 工作负载由 GPU 加速。Grace 正在进行样品调测。

通过 900GB/s 高速芯片对芯片的接口,NVIDIA Grace Hopper 超级芯片可连接 Grace CPU 和 Hopper GPU。黄仁勋解释说,“Grace Hopper 是处理超大型数据集的理想选择,比如用于推荐系统的 AI 数据库和大语言模型。”

“客户希望构建规模大几个数量级的AI数据库,那么 Grace Hopper 是最理想的引擎。”

DGX 是构建 AI 基础设施的蓝图

最新版本的 DGX 搭载 8 个 NVIDIA H100 GPU,它们连接成为一个巨大的GPU。黄仁勋表示:“NVIDIA DGX H100 是全球客户构建AI基础设施的蓝图”,现已全面投入生产。

H100 AI 超级计算机现已开始上线。Oracle Cloud Infrastructure 宣布配备 H100 GPU 的新 OCI Compute 裸机 GPU 实例在一定条件可用。

此外,亚马逊云科技发布了即将推出的 P5 实例 EC2 UltraClusters,其规模可扩展到 2 万个互连的 H100 GPU。

上周,微软 Azure 发布了其 H100 虚拟机 ND H100 v5 的私人预览版。

Meta 现已为其内部的 AI 生产和研究团队部署了由 H100 驱动的 Grand Teton AI 超级计算机。

OpenAI 将在其 Azure 超级计算机上使用 H100 来支持其持续进行的AI研究。

提供 H100 的其他合作伙伴包括 Cirrascale 和 CoreWeave,这两家公司今天都宣布全面上市。此外,Google Cloud、Lambda、Paperspace 和 Vult 都计划提供 H100。

DGX Cloud:随时随地将 AI 带给每家公司

为了加快把 DGX 能力带给初创企业和其他各类企业,以助力其快速打造新产品和制定 AI 战略,黄仁勋发布了 NVIDIA DGX Cloud。通过与微软 Azure、Google Cloud 和 Oracle Cloud Infrastructure 合作,“从浏览器上” 即可实现将 NVIDIA DGX AI 超级计算机 “带给每家公司”。

DGX Cloud 经过优化可以运行 NVIDIA AI Enterprise,这款全球领先的加速软件套件将推动 AI 端到端开发和部署。黄仁勋表示:“DGX Cloud 为客户提供 NVIDIA AI 和世界领先云服务提供商的出色服务。”

NVIDIA 正与领先的云服务提供商一起托管 DGX Cloud 基础设施,Oracle Cloud Infrastructure 是最早合作的云服务提供商。微软Azure 预计将在下个季度开始托管 DGX Cloud,该服务将很快扩展到 Google Cloud 等。

黄仁勋表示,此次合作将 NVIDIA 的生态系统带给云服务提供商,同时扩大了 NVIDIA 的规模和影响力。企业将能够按月租用 DGX Cloud 集群以便快速、轻松地扩展大型多节点训练工作负载的开发。

赋能生成式 AI

为了加速企业使用生成式 AI 的工作,黄仁勋发布了 NVIDIA AI Foundations 云服务系列,为需要构建、完善和运行自定义大型语言模型及生成式AI的客户提供服务,他们通常使用专有数据进行训练并完成特定领域的任务。

AI Foundations服务包括NVIDIA NeMo,用于构建自定义语言文本-文本转换生成模型;Picasso 视觉语言模型制作服务,适用于想要构建使用授权或专有内容训练而成的自定义模型的客户;以及 BioNeMo,助力 2 万亿美元规模的药物研发行业的研究人员。

Adobe 正与 NVIDIA 一起构建一整套用于未来创作工作的新一代 AI。

Getty Images 正在与 NVIDIA 一起训练负责任的生成式文本-图像,以及文本-视频转换基础模型。

Shutterstock 正在与 NVIDIA 一起训练一个生成式文本-3D 转换基础模型,以简化详细 3D 资产的创建。

推动医疗的进步

NVIDIA 宣布,Amgen 正在使用 BioNeMo 加速其药物研发服务。其他 BioNemo 的抢先体验客户包括Alchemab Therapeutics、AstraZeneca、Evozyne、Innophore 和 Insilico。

黄仁勋解释说,BioNeMo 帮助研究人员使用他们的专有数据创建、微调和提供自定义模型。

此外,黄仁勋宣布,NVIDIA 和全球最大的医疗技术提供商 Medtronic 正在一起为软件定义医疗设备构建一个 AI 平台。此次合作将为 Medtronic 系统创建一个涵盖手术导引和机器人辅助手术的通用平台。

Medtronic 今日宣布,其 GI Genius 系统使用 AI 实现了结肠癌早期检测。该系统建立在用于实时传感器处理系统的软件库 NVIDIA Holoscan 之上,并将于今年年底左右出货。

黄仁勋表示:“全球 2500 亿美元的医疗仪器市场正在转型。”

加快生成式AI应用的部署

为了帮助企业部署处于快速发展的生成式 AI 模型,黄仁勋发布了用于 AI 视频、图像生成、大语言模型部署和推荐器推理的推理平台。这些平台将 NVIDIA 的全套推理软件与最新的 NVIDIA Ada、Hopper 和 Grace Hopper 处理器相结合,包括同时在今天推出的 NVIDIA L4 Tensor Core GPU 和 NVIDIA H100 NVL GPU。

- 用于 AI 视频的 NVIDIA L4 可提供比 CPU 高出 120 倍的由 AI 支持的视频性能,同时提高 99% 的能效。

- 用于图像生成的 NVIDIA L40 针对图形以及 AI 赋能的 2D、视频和 3D 图像生成进行了优化。

- 用于大型语言模型部署的 NVIDIA H100 NVL 是规模化部署 ChatGPT 等大型语言模型的理想选择。

- 用于推荐模型的 NVIDIA Grace Hopper 是图形推荐模型、矢量数据库和图形神经网络的理想选择。

Google Cloud 是首家向客户提供 L4 的云服务提供商。该公司已推出新的 G2 虚拟机并在今日提供私人预览版。谷歌还将 L4 集成到其 Vertex AI 模型商店中。

微软与 NVIDIA 一起将 Omniverse 带给数亿用户

黄仁勋宣布,NVIDIA 正在与微软合作,将 NVIDIA Omniverse Cloud 这一完全托管的云服务引入全球各行各业,并推出又一项云服务以加速企业实现前所未有的模拟和协作能力。

黄仁勋表示:“微软和 NVIDIA 将为数亿 Microsoft 365 和 Azure 用户提供 Omniverse” 。他同时还发布了最新 NVIDIA OVX 服务器、搭载 NVIDIA RTX Ada Generation GPU 的新一代工作站,以及英特尔为 NVIDIA Omniverse 优化的最新CPU。

为了展示为 3D 设计协作及数字孪生模拟而构建的开放平台 NVIDIA Omniverse 的强大功能,黄仁勋分享了一段视频,展示了 NVIDIA Isaac Sim 如何通过完全保真的数字孪生帮助亚马逊节省时间和金钱。NVIDIA Isaac Sim是在 Omniverse 基础上构建的机器人模拟和合成生成平台。

该视频展示了亚马逊如何为其第一个完全自主的仓库机器人 Proteus 编排动作,使其能够在亚马逊的巨大仓库中与人类和其他机器人一起搬运装有产品的箱子。

助力 3 万亿美元规模汽车产业的数字化

为了展示 Omniverse 的能力,黄仁勋深入介绍了 Omniverse 在 3 万亿美元汽车产业数字化中的作用。黄仁勋表示,到 2030 年,汽车制造商将建立 300 家工厂,生产 2 亿辆电动汽车,而电池制造商正在建设 100 家巨型工厂。他表示:“数字化将提高该行业的效率、生产力和速度。”

谈到 Omniverse 在整个行业的应用,黄仁勋表示,Lotus 正在使用 Omniverse 以虚拟方式组装焊接站。梅赛德斯-奔驰使用 Omniverse 为新车型建立、优化和规划装配线。Rimac 和 Lucid Motors 在 Omniverse 上使用真实设计数据创建数字商店,以实现对汽车逼真的描绘。

宝马与 Idealworks 合作,使用 Omniverse 中的 Isaac Sim 生成训练工厂机器人的合成数据和场景。黄仁勋表示,宝马正在使用 Omniverse 规划全球工厂的运营,在实际工厂开业两年之前,他们会在 Omniverse 中完整建造一间新的电动汽车工厂。

NVIDIA 还宣布全球领先的新能源汽车制造商比亚迪将在其更广泛的车型中扩展对 NVIDIA DRIVE Orin 集中式计算平台的使用。

加速半导体行业的突破

黄仁勋宣布,随着当前生产工艺接近物理学的极限,NVIDIA cuLitho 将助力 ASML、TSMC 和 Synopsis 等半导体领导者加速新一代芯片的设计和制造。这项突破将加速计算引入到计算光刻领域。

全球领先的代工厂 TSMC,以及电子设计自动化领域的领导者 Synopsys 正在将全新的 NVIDIA cuLitho 计算光刻技术软件库整合到最新一代 NVIDIA Hopper 架构 GPU 的软件、制造工艺和系统中。

设备制造商 ASML 正在 GPU 和 cuLitho 方面与 NVIDIA 展开合作,并计划在其所有计算光刻软件产品中加入对 GPU 的支持。黄仁勋表示,光刻技术已临近物理极限,NVIDIA 推出的 cuLitho 可为行业的 2 纳米及更高工艺奠定基础。

他表示:“芯片产业几乎是每一个行业的基础。”

加速全球大型企业的发展

众多知名的全球企业均支持黄仁勋的愿景。

电信巨头 AT&T 采用 NVIDIA AI,以实现更高效地数据处理。同时,他们正在测试 Omniverse ACE 和 Tokkio AI 虚拟化身工作流为客服部门及其员工帮助台建立、定制和部署虚拟助手。

美国运通、美国邮政署、Microsoft Office 和 Teams 以及亚马逊等 4 万家客户都在使用高性能的 NVIDIA TensorRT 推理优化器和运行时,以及多框架数据中心推理服务软件 NVIDIA Triton。

Uber 使用 Triton 实现每秒为数十万车辆预测到达时间。

拥有超过 6000 万日活用户的 Roblox 使用 Triton 提供游戏推荐模型、构建头像、审核内容和市场广告。

微软、腾讯和百度都在使用 NVIDIA CV-CUDA 实现 AI 计算机视觉。这项目前处于公测阶段的技术可优化前处理和后处理,节省 4 倍成本和能耗。

助力完成不可能的任务

在演讲尾声,黄仁勋向 NVIDIA 的系统、云和软件合作伙伴以及研究人员、科学家和员工致谢。

黄仁勋宣布,NVIDIA 已更新了 100 个加速库,包括用于量子计算的 cuQuantum 和新开源的 CUDA Quantum、用于组合优化的 cuOpt 以及用于计算光刻的 cuLitho。

黄仁勋表示,全球 NVIDIA 生态目前已有 400 万名开发者、4 万家公司和 NVIDIA 初创加速计划中的 1.4 万家初创企业。

“我们正在助力全球完成不可能的任务。”

观看 GTC 2023 主题演讲重播请访问:https://www.nvidia.cn/gtc-global/keynote/