新闻摘要:

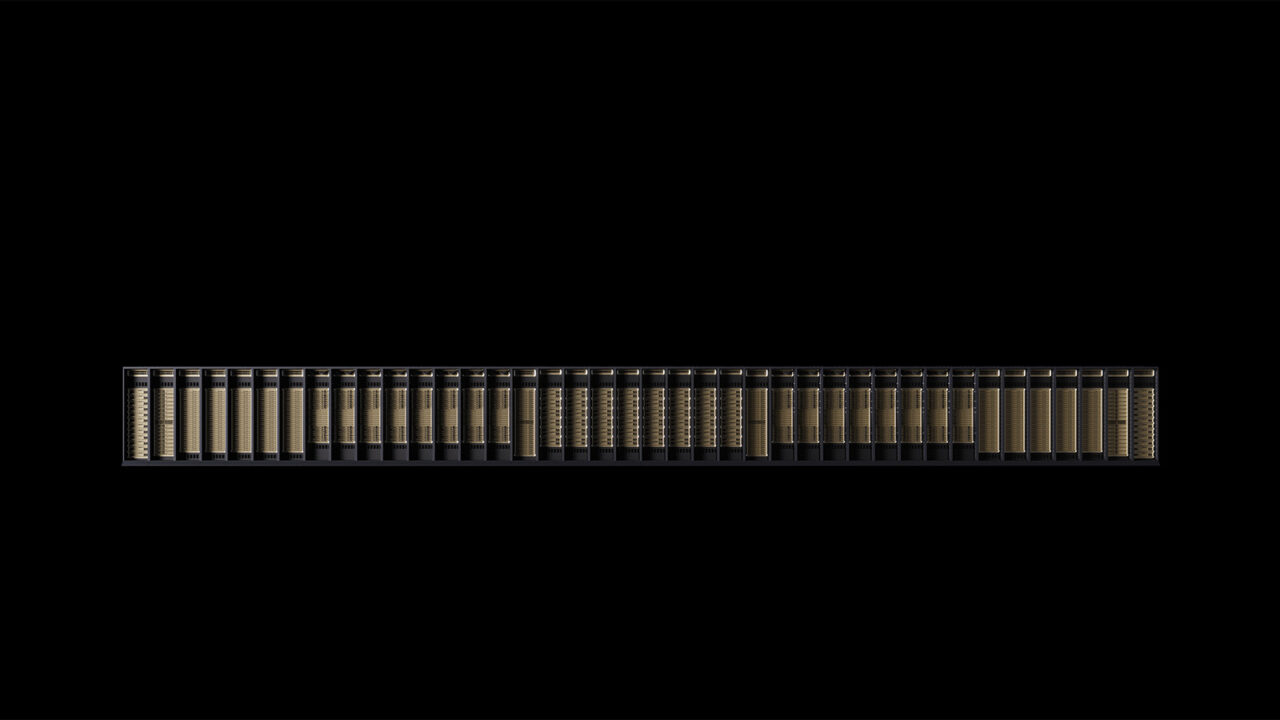

NVIDIA Vera Rubin 平台正开启下一个 AI 前沿:

- Vera Rubin NVL72 GPU 机架

- Vera CPU 机架

- NVIDIA Groq 3 LPX 推理加速器机架

- NVIDIA BlueField-4 STX 存储机架

- NVIDIA Spectrum-6 SPX 以太网机架

加利福尼亚州圣何塞 — GTC — 太平洋时间 2026 年 3 月 16 日 — NVIDIA 今日宣布,NVIDIA Vera Rubin 平台正开启代理式 AI 的下一个前沿。目前,该平台搭载的七款新芯片现已全面投产,旨在扩展全球最大 AI 工厂的规模。

该平台集成了 NVIDIA Vera CPU、NVIDIA Rubin GPU、NVIDIA NVLink™ 6 交换机、NVIDIA ConnectX®-9 SuperNIC、NVIDIA BlueField®-4 DPU 和 NVIDIA Spectrum™-6 以太网交换机,以及新纳入的 NVIDIA Groq 3 LPU。这些芯片设计为协同运作,构成一台强大的 AI 超级计算机,可为 AI 的各个阶段提供动力——从大规模预训练、后训练、测试阶段扩展到实时智能体式推理。

NVIDIA 创始人兼首席执行官黄仁勋表示:“Vera Rubin 是一次划时代的飞跃——七款突破性芯片、五种机架、一台巨型超级计算机——旨在为 AI 的每个阶段提供澎湃动力。代理式 AI 的拐点已经到来,Vera Rubin 正拉开历史上最大规模的基础设施建设序幕。”

“企业和开发者正在使用 Claude 进行日益复杂的推理、智能体工作流以及关键任务的决策,这要求基础设施必须能够跟上步伐。”Anthropic CEO 兼联合创始人 Dario Amodei 表示。“NVIDIA 的 Vera Rubin 平台为我们提供了计算、网络和系统设计,使我们在不断提升客户所依赖的安全性和可靠性的同时,能够持续提供卓越性能。”

OpenAI 首席执行官 Sam Altman 表示:“NVIDIA 的基础设施是让我们不断推动 AI 前沿发展的基石。借助 NVIDIA Vera Rubin,我们将能够以大规模运行更强大的模型和智能体,并为数亿用户提供更快速、更可靠的系统。”

转向 POD 级系统

AI 基础设施正快速演进——从分立芯片和单机服务器,向完全集成的机架级扩展系统、POD 级部署、AI 工厂和主权 AI 发展。这些进步正推动性能实现跨越式增长,并为各个行业各种规模的机构提升成本效益,从初创公司、中型企业,到公共和私营机构和大型企业。同时,这也有助于普及 AI 技术,并提高能效,从而为全球最严苛的工作负载提供动力。

通过跨计算、网络与存储的深度协同设计,并依托由 80 多家 NVIDIA MGX 生态系统合作伙伴组成的全球供应链,NVIDIA Vera Rubin 提供了迄今规模最大的 NVIDIA POD 级平台——这是一款超级计算机,其中多个专为 AI 设计的机架协同运作,构成一个庞大且统一的强大系统。

NVIDIA Vera Rubin NVL72 机架

Vera Rubin NVL72 集成了通过 NVLink 6 互连的 72 个 Rubin GPU 和 36 个 Vera CPU,并配备了 ConnectX-9 SuperNIC 与 BlueField-4 DPU,从而实现了突破性的效率表现。与 NVIDIA Blackwell 平台相比,Vera Rubin NVL72 仅需四分之一数量的 GPU 即可训练大型混合专家模型,每瓦特推理吞吐量最高可提升 10 倍的同时,每 Token 成本仅为原平台的十分之一。

NVL72 专为全球超大规模 AI 工厂设计,通过 NVIDIA Quantum-X800 InfiniBand 和 Spectrum-X 以太网实现无缝扩展,保持大规模 GPU 集群的高利用率,同时缩短训练时间并降低总体拥有成本。

NVIDIA Vera CPU 机架

强化学习和代理式 AI 工作负载依赖大量基于 CPU 的环境,来测试和验证在 GPU 系统上运行的模型所生成的结果。

NVIDIA Vera CPU 机架提供基于 NVIDIA MGX 打造的高密度液冷基础设施,单机架集成 256 个 Vera CPU,以全球领先的单线程性能,提供可扩展且高能效的算力,从而解锁大规模代理式 AI 的潜力。

与 Spectrum-X 以太网集成后,Vera CPU 机架确保 CPU 环境在整个 AI 工厂内保持高度同步。与 GPU 计算机架协同,它们为大规模代理式 AI 与强化学习提供坚实的 CPU 基础——Vera 的性能表现比传统 CPU 效率提升一倍,速度提升了 50%。

NVIDIA Groq 3 LPX 机架

NVIDIA Groq 3 LPX 标志着加速计算领域的一个重要里程碑。专为智能体系统的低延迟和长上下文需求而设计,LPX 与 Vera Rubin 强强联合,汇聚了两款处理器的极致性能,使得每兆瓦的推理吞吐量提升高达 35 倍,并为万亿参数模型带来了多达 10 倍的营收机遇。

大规模部署时,由 LPU 组成的集群能够作为一个巨大的单一逻辑处理器运行,提供快速、确定性的推理加速。LPX 机架搭载 256 个 LPU 处理器,配备 128GB 片上 SRAM 和 640 TB/s 的纵向扩展带宽。与 Vera Rubin NVL72 协同部署时,Rubin GPU 和 LPU 通过协同计算 AI 模型的每一层来生成每一个 Token,从而显著提升解码速度。

为万亿参数模型和百万级 Token 上下文而优化协同设计的 LPX 架构,与 Vera Rubin 强强联合,最大限度地提高了功耗、内存和计算方面的效率。每瓦特吞吐量和 Token 性能的提升,开启了超高端、万亿参数、百万上下文推理的新纪元,为所有 AI 提供商拓展了营收机遇。该架构采用全液冷设计,并基于 MGX 基础设施构建,可无缝集成到下一代 Vera Rubin AI 工厂中,预计将在今年下半年面世。

NVIDIA BlueField-4 STX 存储机架

NVIDIA BlueField-4 STX 机架级扩展系统作为 AI 原生存储基础设施,可在整个 POD 中无缝扩展 GPU 内存。STX 由 BlueField-4 提供支持,集成了 NVIDIA Vera CPU 与 NVIDIA ConnectX-9 SuperNIC。该平台提供了高带宽共享层,且优化了存储和检索大语言模型与代理式 AI 工作流产生的海量 KV 缓存数据。

全新推出的 DOCA 软件框架 NVIDIA DOCA Memos™ 可显著提升 BlueField-4 存储性能。通过专用的 KV 缓存存储处理技术,与通用存储架构相比,可将推理吞吐量提升 5 倍,并显著提高能效。最终实现 POD 范围内的上下文共享,从而加快与 AI 智能体的多轮交互速度,提供更具可扩展性的 AI 服务,并提高整体基础设施利用率。

Mistral AI 联合创始人兼首席技术官 Timothée Lacroix 表示:“NVIDIA BlueField-4 STX 机架级扩展上下文记忆存储系统将提供关键的性能提升,使我们能够实现代理式 AI 的指数级扩展。通过提供一个专为 AI 智能体记忆设计的全新存储层,STX 能够确保我们的模型在跨海量数据集进行推理时依然保持连贯性和速度。”

NVIDIA Spectrum-6 SPX 以太网机架

Spectrum-6 SPX 以太网专为加速 AI 工厂“东西向”流量而设计。该机架可灵活配置 Spectrum-X 以太网交换机或 NVIDIA Quantum-X800 InfiniBand 交换机,能够在大规模部署中提供低延迟、高吞吐量的机架间互连。

采用光电一体封装 (CPO) 的 Spectrum-X 以太网硅光技术,相比传统可插拔收发器,光学能效最高提升 5 倍,系统可靠性提高 10 倍。

提升可靠性与能效

NVIDIA 携手超过 200 家数据中心基础设施合作伙伴,共同推出了针对 Vera Rubin 的 NVIDIA DSX 平台,其包含 DSX Max-Q,旨在为整个 AI 工厂实现动态供电,从而在固定功率的数据中心内部署的 AI 基础设施数量可增加 30%。此外,全新的 DSX Flex 软件使 AI 工厂转变为电网柔性资产,从而释放 1000 亿瓦的闲置电网容量。

NVIDIA 今日还发布了 Vera Rubin DSX AI Factory 参考设计,为协同设计的 AI 基础设施提供蓝图,旨在最大化每瓦特 Token 产出和整体有效吞吐,增强系统可靠性,并缩短首次投产时间。

通过深度集成计算、网络、存储、供电与冷却系统,该架构显著提升了能源效率,确保 AI 工厂在持续、高强度负载下,仍能可靠扩展,实现最大化的正常运行时间。

广泛的生态系统支持

今年下半年,合作伙伴将陆续推出基于 Vera Rubin 的产品,包括领先的云服务提供商 Amazon Web Services、Google Cloud、Microsoft Azure 和 Oracle Cloud Infrastructure,以及 NVIDIA 云合作伙伴 CoreWeave、Crusoe、Lambda、Nebius、Nscale 和 Together AI。

思科、戴尔科技、HPE、联想和 Supermicro 等全球系统制造商预计将推出一系列基于 Vera Rubin 产品的服务器,包括 Aivres、华硕、Foxconn、技嘉、Inventec、Pegatron、Quanta Cloud Technology (QCT)、Wistron 和 Wiwynn 在内的其他厂商也将提供相关产品。

包括 Anthropic、Meta、Mistral AI 和 OpenAI 在内的 AI 实验室与前沿大模型开发商,计划采用 NVIDIA Vera Rubin 平台训练规模更大、能力更强的模型,并以比以往 GPU 更低的延迟和成本提供长上下文与多模态系统服务。

关于 NVIDIA

NVIDIA(NASDAQ: NVDA)是 AI 和加速计算领域的全球领导者。

该新闻稿所含若干陈述包括(但不限于)有关以下各项的陈述:Rubin 的到来恰逢其时;随着我们以每年推出新一代 AI 超级计算机,并在六款新芯片上进行深度协同设计,Rubin 正为 AI 的下一个前沿带来重大飞跃;Vera Rubin 是一项划时代的飞跃,旨在为 AI 的每个发展阶段提供澎湃动力;Vera Rubin 正拉开历史上最大规模的基础设施建设序幕;对 NVIDIA 产品、服务和技术的优势、影响、性能和可用性;对 NVIDIA 与第三方(包括其合作者和合作伙伴)的相关预期;对技术发展及相关趋势预期;以及其他非历史事实的陈述,均属前瞻性陈述,这些都是符合 1933 年《证券法》第 27A 条(经修订)和 1934 年《证券交易法》第 21E 条(经修订)所定义的前瞻性声明。前瞻性声明受到这些法律条款创建的“安全港”保护,基于管理层当前可获得的信息及其信念与假设,并受风险与不确定性的影响,可能导致结果与预期有重大差异的风险和不确定因素。可能导致实际结果产生重大差异的重要因素包括:全球经济状况与政治环境;我们依靠第三方来制造、组装、包装和测试我们的产品;技术发展和竞争的影响;新产品和技术的开发或者现有产品升级;我们产品或合作伙伴产品的市场认可度;设计、制造或软件缺陷;消费者偏好或需求的变化;行业标准和接口变化;我们产品或技术在集成到系统中时发生的意外性能损失;以及适用法律法规的变更。NVIDIA 向美国证券交易委员会(SEC)提交最新报告中不时详述的其他因素,这些报告包括(但不限于)采用 10-K 表的年度报告和采用 10-Q 表的季度报告。向 SEC 提交的报告的副本均在 NVIDIA 的官方网站上发布,并可免费下载。以上前瞻性陈述并非未来表现的保证,仅以本协议日期为准;除法律要求外,NVIDIA 不承担更新以上前瞻性陈述以反映未来事件或情况的任何义务。

本文中描述的许多产品和功能仍处于不同阶段并将在能够提供时提供。上述声明无意也不应被解释为承诺、允诺或法律义务。我们产品的开发、发布以及所描述的任何特性或功能的推出时间均可能发生变化,并由 NVIDIA 自行决定。NVIDIA 不对本文中所述的任何产品、特性或功能的未交付或延迟交付承担任何责任。

© 2026 NVIDIA Corporation 保留一切权利。NVIDIA、NVIDIA 商标、BlueField、CMX、ConnectX、DOCA Memos、MGX、NVIDIA Spectrum、NVIDIA Spectrum-X,以及 NVLink 均为 NVIDIA Corporation 在美国和/或其他国家的商标和/或注册商标。其他公司和产品名称可能是与其相关的各家公司的商标。功能、价格、可用性和规格如有更改,恕不另行通知。