AI 智能体的准确性、相关性和及时性由驱动它的数据所决定。

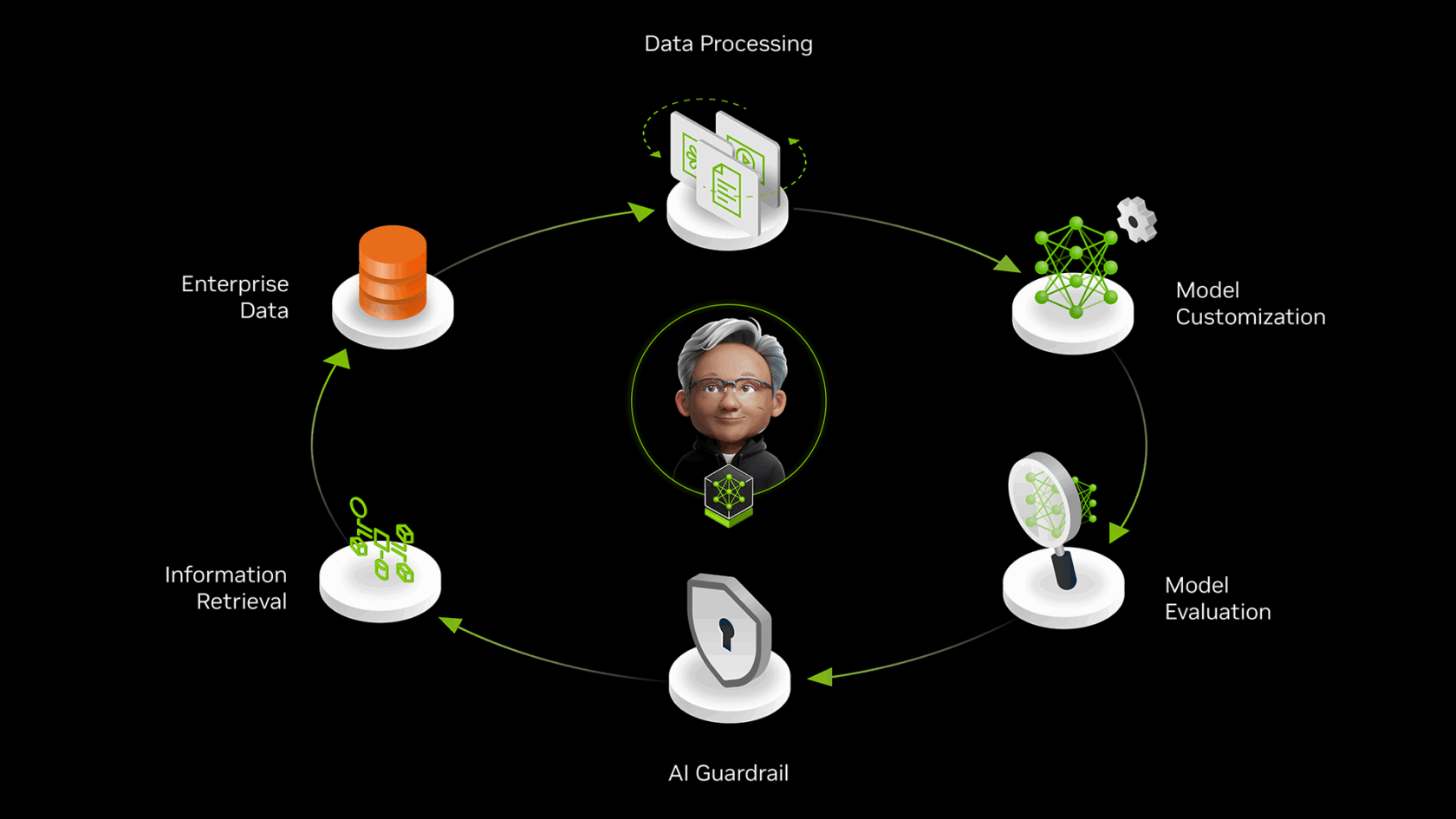

NVIDIA NeMo 微服务现已全面推出,可帮助企业 IT 部门快速构建 AI 团队,通过数据飞轮提高员工生产力。这些微服务提供了一个端到端的开发者平台,用于创建先进的代理式 AI 系统,并根据推理和业务数据以及用户偏好使用数据飞轮,以不断优化这些系统。

借助数据飞轮,企业 IT 部门可以让 AI 智能体作为数字成员加入。这些智能体可以利用用户交互以及 AI 推理过程中生成的数据,不断提升模型性能——将用例转化为洞察,继而将洞察转化为行动。

为代理式 AI 构建强大的数据飞轮

如果没有来自数据库、用户交互或现实世界信号的持续高质量输入,智能体的理解能力就会下降,导致其输出不再可靠,并且降低智能体的效率。

要维护和优化生产环境中驱动 AI 智能体的模型,需要三类数据:用于获取洞察并适应数据模式演变的推理数据,提供智能的最新业务数据,以及验证模型与应用表现是否符合预期的用户反馈数据。而 NeMo 微服务能帮助开发者有效利用这三类数据。

NeMo 微服务通过端到端工具加快 AI 智能体的开发。这些工具可用来策划、定制、评估和保护驱动智能体的模型。

NVIDIA NeMo 微服务(包括 NeMo Customizer、NeMo Evaluator 和 NeMo Guardrails)可与 NeMo Retriever 和 NeMo Curator 一起使用,通过定制企业数据飞轮,简化企业构建、优化和扩展 AI 智能体的体验。例如:

- NeMo Customizer 加速大语言模型微调,将训练吞吐量提升至高 1.8 倍。这一高性能、可扩展的微服务采用主流的后训练技术,包括监督微调和低秩自适应。

- NeMo Evaluator 只需五次应用程序接口 (API) 调用,即可简化自定义以及行业基准 AI 模型和工作流的评估。

- NeMo Guardrails 仅需额外半秒延迟,即可将合规性保护提高至多 1.4 倍,帮助组织实施符合组织政策和准则的强效安全防护措施。

借助 NeMo 微服务,开发者可以构建数据飞轮,从而提升 AI 智能体的准确性和效率。NeMo 微服务通过 NVIDIA AI Enterprise 软件平台部署,易于操作,并且可在任何加速计算的基础设施(本地或云端)上运行,提供企业级的安全性、稳定性和支持。

随着企业构建大规模多智能体系统,微服务已愈发普及。在多智能体系统中,数百个具有不同目标和工作流的专用智能体作为数字员工,协同处理复杂的任务,与员工并肩工作,实现跨职能的辅助工作并提升效率。

这种企业范围的影响使 AI 智能体成为了一个价值万亿美元的商机,其应用涵盖自动欺诈检测、购物助手、预测性机器维护和文档审查,同时也突显了数据飞轮在将业务数据转化为可操作见解方面的关键作用。

行业领导者通过 NVIDIA NeMo 微服务提升 AI 智能体的准确性

NVIDIA 合作伙伴和行业领导者正在使用 NeMo 微服务构建响应式 AI 智能体平台,以便数字团队成员能够帮助完成更多工作。

AT&T 与 Arize 和 Quantiphi 合作,使用 NVIDIA NeMo 构建了一个先进的 AI 智能体,用于处理包含近 10,000 份文档且每周更新的知识库。这款可扩展的高性能 AI 智能体针对三大关键业务重点进行了微调:速度、成本效益和准确性,随着应用规模的扩大,其重要性与日俱增。

AT&T 使用 NeMo Customizer 和 Evaluator,通过微调 Mistral 7B 模型,将 AI 智能体的准确率提高了 40%,从而帮助提供个性化服务、防止欺诈并优化网络性能。

贝莱德 (BlackRock) 正在其 Aladdin 技术平台中应用 NeMo 微服务以实现代理式 AI 功能,该平台通过通用数据语言统一投资管理流程。

思科 Outshift 团队与 Galileo 一起使用 NVIDIA NeMo 微服务为编码助手提供支持,可将工具选择错误减少 40%,并将响应时间加快 10 倍。

纳斯达克正在基于 NeMo Retriever 微服务和 NVIDIA NIM 微服务加速纳斯达克生成式 AI 平台。NeMo Retriever 增强了该平台的搜索功能,使准确率和响应时间提高了 30%,并节省了成本。

NVIDIA NeMo 微服务获广泛模型和合作伙伴生态系统支持

NeMo 微服务支持众多主流的开放模型,包括 Llama、微软 Phi 系列小语言模型、Google Gemma、Mistral 和 NVIDIA Llama Nemotron Ultra,Llama Nemotron Ultra 是目前在科学推理、编码和复杂数学基准测试中领先的开放模型。

Meta 已通过全新连接器 Meta Llamastack 接入 NVIDIA NeMo 微服务。用户可以通过 API 访问相同的功能,包括 NVIDIA Customizer、Evaluator 和 Guardrails,从而能够在其环境中运行全套智能体构建工作流。

Meta GenAI 软件工程师 Raghotham Murthy 表示:“通过 Llamastack 集成,智能体构建者可以应用由 NeMo 微服务驱动的数据飞轮,这使他们能够持续优化模型,从而提高准确性、提升效率并降低总体拥有成本。”

Cloudera、Datadog、Dataiku、DataRobot、DataStax、SuperAnnotate、Weights & Biases 等领先的 AI 软件提供商已将 NeMo 微服务集成到其平台中。开发者可以在热门 AI 框架(包括 CrewAI、deepset 开发的 Haystack、LangChain、LlamaIndex 和 Llamastack)中使用 NeMo 微服务。

企业可以使用 NVIDIA AI 数据平台产品,通过 NeMo Retriever 微服务构建数据飞轮,这些产品来自企业级 NVIDIA 认证的存储合作伙伴,包括 DDN、戴尔科技、慧与、Hitachi Vantara、IBM、NetApp、Nutanix、Pure Storage、VAST Data 和 WEKA。

领先的企业平台(包括 Amdocs、Cadence、Cohesity、SAP、ServiceNow 和 Synopsys)正在其 AI 智能体解决方案中使用 NeMo Retriever 微服务。

企业可以在 NVIDIA 加速的基础架构、网络和来自领先系统提供商(包括思科,戴尔科技,慧与和联想)的软件上运行 AI 智能体。

埃森哲、德勤、安永等咨询类领先企业正在通过 NeMo 微服务为企业构建 AI 智能体平台。

开发者可以从 NVIDIA NGC 目录下载 NeMo 微服务。这些微服务可以作为 NVIDIA AI Enterprise 的一部分进行部署,提供长期稳定的软件分支,以实现 API 的稳定性、主动安全修复和企业级支持。