传统数据中心过去主要用于数据的存储、检索与处理。但在生成式 AI 与代理式 AI 时代,这些设施已演变为 AI Token 工厂。随着 AI 推理成为其核心工作负载,它们的主要产出已转变为以 Token 形式制造的智能。

这一转变也需要对包括总体拥有成本 (TCO) 在内的 AI 基础设施的经济效益评估的方式相应地进行调整。然而,在评估 AI 基础设施时,企业仍过于关注芯片峰值规格、计算成本,或每美元所能获得的浮点运算性能,即每美元 FLOPS。

关键区别在于:

- 算力成本是企业为 AI 基础设施所支付的费用,无论是从云服务提供商租用,还是在本地自建部署。

- 每美元 FLOPS 衡量的是企业每投入一美元所获得的原始算力,但原始算力并不等同于现实世界中的 Token 产出。

- 每 Token 成本指的是企业生成并交付每一个 Token 的综合成本,通常以每百万 Token 成本来表示。

前两者仅是投入指标。但当业务围绕产出运转时,只针对投入优化,本质上是一种根本性的错配。

每 Token 成本决定了企业能否实现 AI 的规模化盈利。它是唯一能够直接综合反映硬件性能、软件优化、生态系统支持以及实际利用率的 TCO 指标,而 NVIDIA 在这一指标上实现了行业最低的每 Token 成本。

能够降低每 Token 成本的因素有哪些?

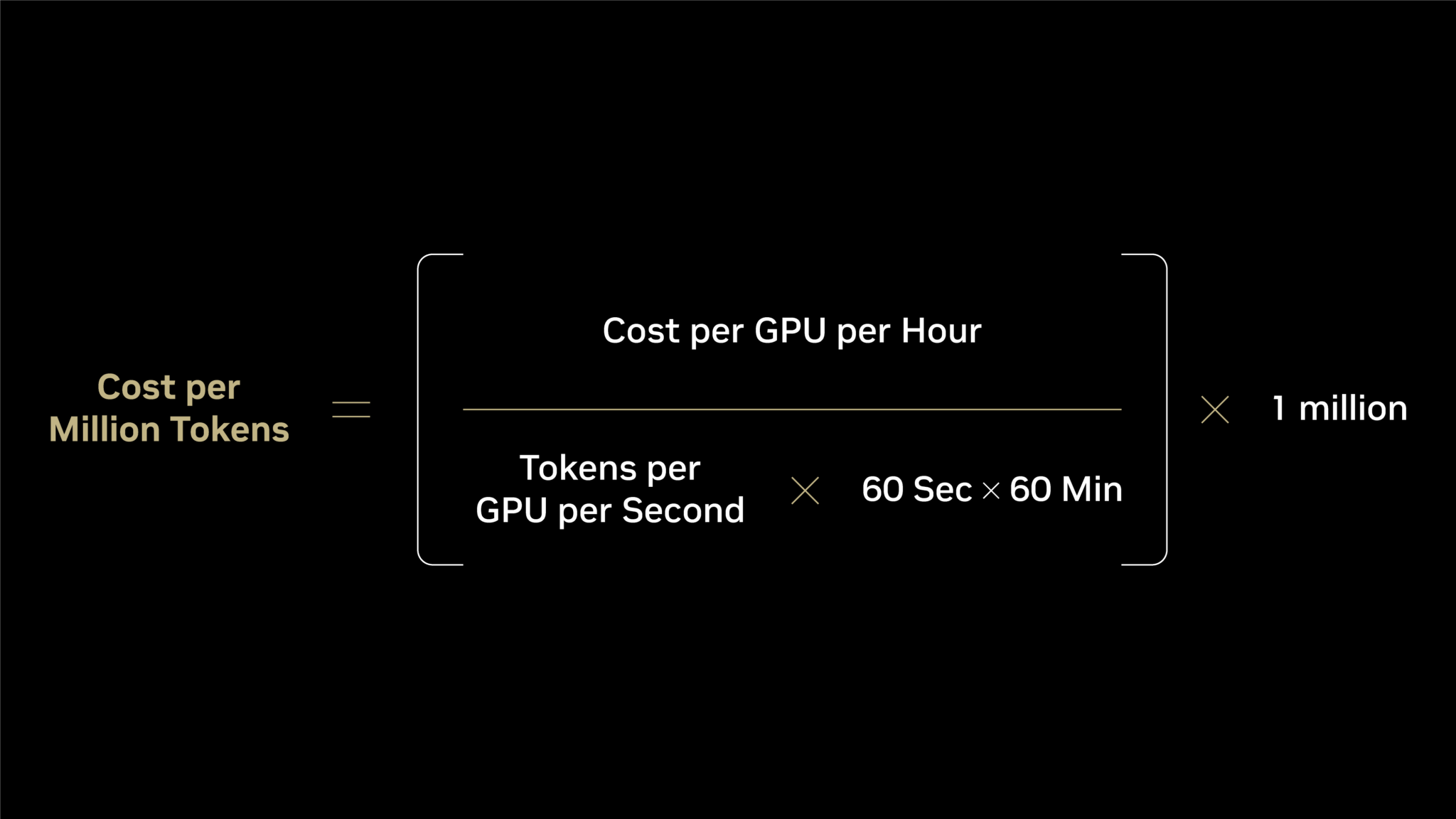

要理解如何优化每 Token 成本,首先需要了解用于计算“每百万 Token 成本”的计算公式。

在这个公式中,许多评估 AI 基础设施的企业往往只关注分子项,即每 GPU 每小时成本。对于云部署而言,这对应支付给云服务提供商的小时费用;而对于本地部署,则是通过摊销自有基础设施得到的等效小时成本。然而,降低每 Token 成本的关键在于分母,即最大化实际交付的 Token 产出。

这个分母传递了两层商业含义:

- 最小化每 Token 成本:当 Token 产出增加被代入公式时,将降低每 Token 成本,从而提升每一次交互服务的利润空间。

- 最大化收入:每秒交付更多 Token,也意味着每兆瓦产出更多的 Token,这将带来更高的智能供给能力,使 AI 驱动的产品与服务能够在相同基础设施投入下创造更高收入。

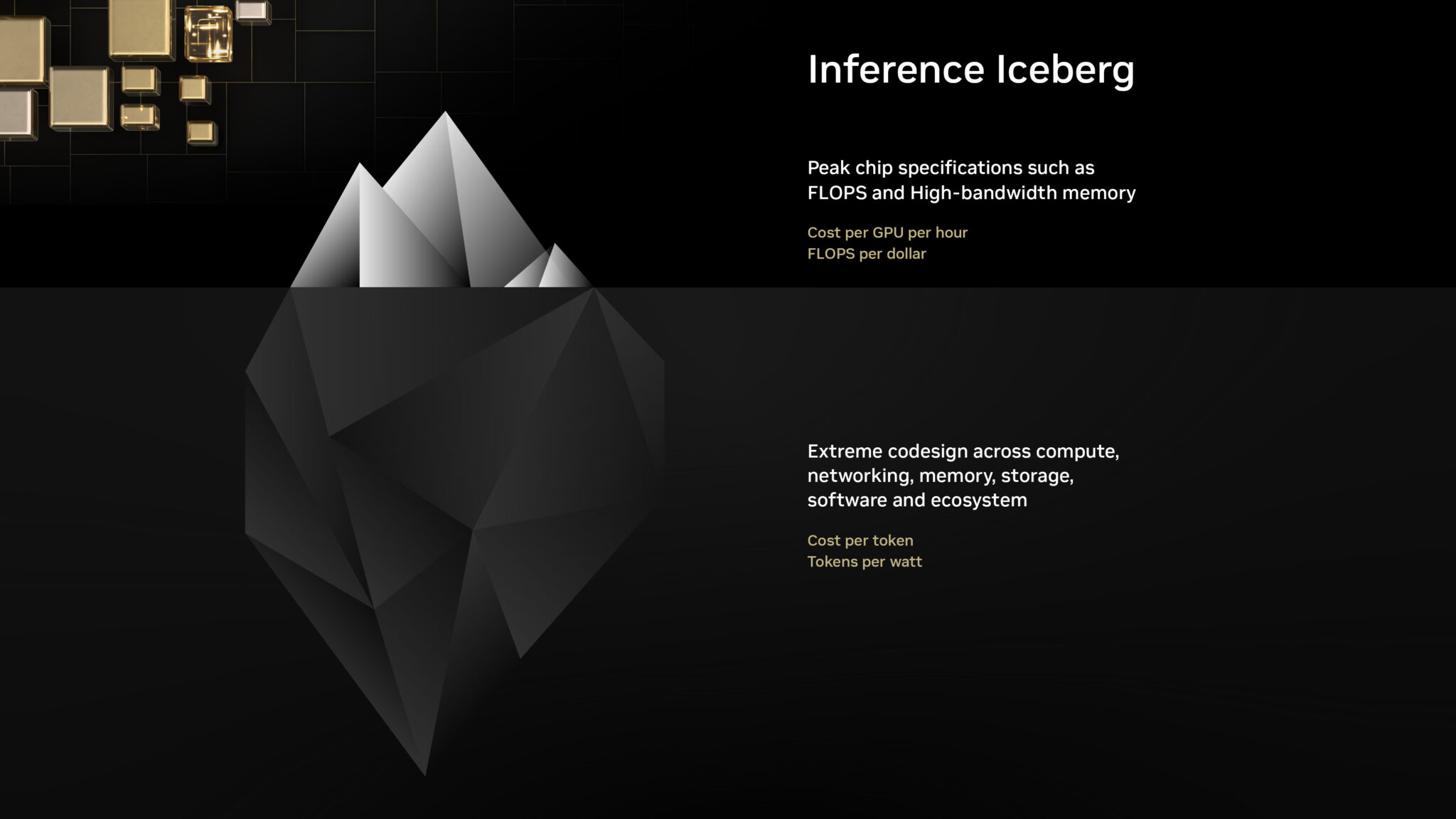

因此,如果只关注分子,就会忽视真正决定分母的因素。可以将其理解为一个“推理冰山”:分子位于水面之上,直观可见且易于横向比较;而分母则隐藏在水面之下,那才是决定实际 Token 产出的关键因素。对 AI 基础设施的准确评估,应从探究水面之下的部分开始。

- 表层问题:

- 每 GPU 小时的成本是多少?

- 峰值 PetaFLOPS 性能和高带宽内存容量是多少?

- 每美元可获得多少 FLOPS?

- 深度成本分析:

- 每百万 Token 的成本是多少?尤其是针对大规模混合专家 (MoE) 推理模型 (当前部署最广泛的一类 AI 模型),其每百万 Token 成本是多少?

- 每兆瓦可交付多少 Token 产出?尤其是对本地部署而言,由于在土地、电力与基础设施上的资本投入较大,最大化每兆瓦所产生的智能产出至关重要。

- 纵向扩展 (scale-up) 互连是否能够支撑 MoE 模型所需的“all-to-all”通信模式?

- 是否支持 FP4 精度?推理栈是否能够在保持高精度的同时充分利用 FP4?

- 推理运行时是否支持投机解码或多 Token 预测,以提升用户交互体验?

- 服务层是否支持解耦服务、KV 感知路由、KV 缓存卸载以及其他优化?

- 平台是否支持代理式 AI 的独特工作负载需求,包括超低延迟、高吞吐以及长输入序列长度等?

- 平台是否支持从训练、后训练到大规模推理的完整生命周期,并覆盖所有模型架构,从而实现基础设施可互换性与高利用率?

这些算法、硬件与软件化中的每一项优化都必须有效并且是可以相互集成的,否则分母项将无法成立。一块看似“更便宜”的 GPU,如果其每秒 Token 产出数量明显更低,反而会导致更高的每 Token 成本。能够做到全栈真正优化的 AI 基础设施,才能够确保每项优化都相互增强,从而持续提升整体效率。

为什么每 Token 成本比每美元 FLOPS 更重要?

以下 DeepSeek-R1 AI 模型的数据展示了理论指标与实际商业结果之间的差异。

仅从算力成本来看,NVIDIA Blackwell 平台的成本似乎约为 NVIDIA Hopper 的 2 倍,但算力成本并不能说明这项投入究竟能带来多少实际产出。如果仅以每美元 FLOPS 进行分析,相较于 NVIDIA Hopper 架构,NVIDIA Blackwell 仅有约 2 倍优势。然而,实际结果却呈现出数量级差异:Blackwell 每瓦的 Token 产出量是 Hopper 的 50 倍以上,每百万 Token 的成本降低至其 1/35 左右。

| 指标 | NVIDIA Hopper (HGX H200) | NVIDIA Blackwell (GB300 NVL72) | Blackwell 相较 Hopper |

| GPU 每小时成本 (美元) | $1.41 | $2.65 | 2x |

| 每美元 FLOPS (PFLOPS) | 2.8 | 5.6 | 2x |

| 每 GPU 每秒 Token 产出 | 90 | 6,000 | 65x |

| 每兆瓦 Token 产出 | 54K | 2.8M | 50x |

| 每百万 Token 成本 (美元) | $4.20 | $0.12 | 降为 1/35 |

注:数据来源于 NVIDIA 分析报道及 SemiAnalysis InferenceX v2基准测试。

这一悬殊差异表明,相较于上一代 Hopper,NVIDIA Blackwell 在商业价值上实现了巨大的跃迁,其提升幅度远超系统成本的增加。

如何选择合适的 AI 基础设施?

仅凭算力成本或每美元理论 FLOPS 来比较 AI 基础设施,不仅是不充分的,也无法真实反映推理经济学。正如数据所展示的,要准确评估 AI 基础设施的营收潜力与盈利能力,需将衡量维度从输入指标转向每 Token 成本和实际 Token 产出量。

NVIDIA 通过在计算、网络、内存、存储、软件以及合作伙伴技术上的极致协同设计,实现了业内最低的 Token 成本与最高的 Token 吞吐量。此外,诸如 vLLM、SGLang、NVIDIA TensorRT-LLM 以及 NVIDIA Dynamo 等基于 NVIDIA 平台构建的开源推理软件的持续优化,意味着在现有 NVIDIA 基础设施部署后,Token 产出仍可不断提升,每 Token 成本会持续下降。 领先的云服务提供商与 NVIDIA 云合作伙伴,已在规模化部署中充分体现这一优势。包括 CoreWeave、Nebius、Nscale 与 Together AI 在内的合作伙伴,已部署 NVIDIA Blackwell 基础设施,并对其技术栈进行了优化,为企业提供当前最低的 Token 成本,同时充分发挥 NVIDIA 在硬件、软件与生态系统协同设计方面的全部优势,使每一次 AI 交互的处理都建立在这一完整体系之上。

请根据您所在区域适用的法律要求浏览、选择和使用资源。