AI 智能体已经彻底改变了开发者的工作流,而它们迎来的下一个前沿领域是知识型工作:处理信息、解决复杂问题、提出新想法和推动创新。

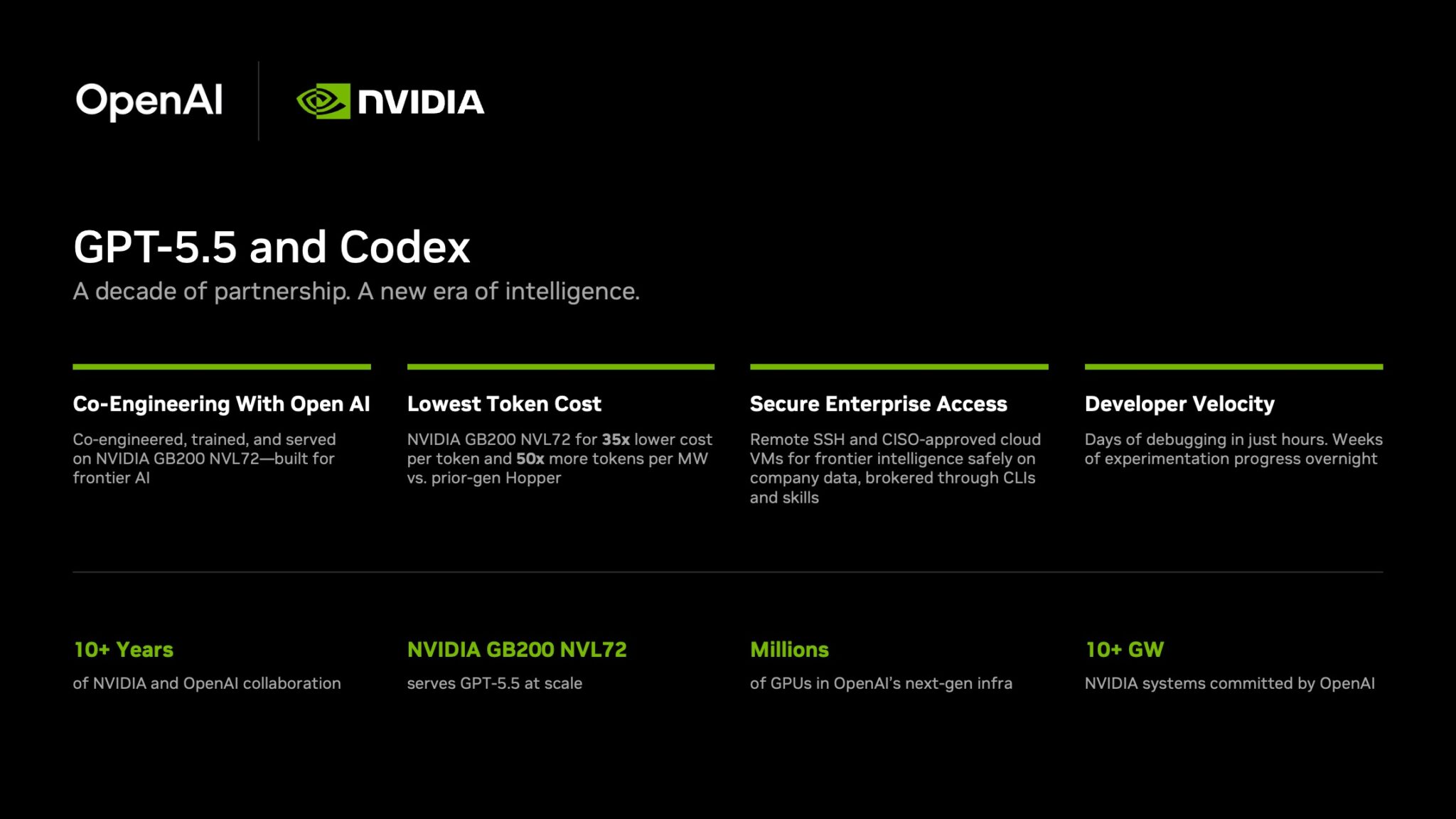

OpenAI 的代理式编码应用 Codex 正在推动这一全新前沿领域的发展。该应用现在由 OpenAI 最新的前沿模型 GPT-5.5 提供支持,并运行在 NVIDIA Grace Blackwell 机架级扩展系统上。

超过 1 万名 NVIDIA 员工——涵盖工程、产品、法律、营销、财务、销售、人力资源、运营和开发者项目等部门——正在使用由 GPT-5.5 提供支持的 Codex,并称其效果“令人惊叹”和“足以改变生活”。

NVIDIA 工程师已通过 Codex 应用使用 GPT-5.5 长达数周时间,其带来的成果是显著且可衡量的。该模型在 NVIDIA Grace Blackwell 机架级扩展系统上运行,与上一代系统相比,每百万 Token 的成本降至原本的三十五分之一,每兆瓦每秒的 Token 吞吐量提升了 50 倍。这种经济效益使前沿模型推理在企业级规模上的应用成为可能。

过去长达数天的调试周期现在缩短至数小时。在复杂的多文件代码库中,以前需要数周才能完成的实验现在仅需一夜即可取得进展。团队正在通过自然语言提示词推出端到端功能,与早期模型相比,其可靠性不仅大幅提升,更减少了无效损耗的时间成本。

OpenAI 的惊人进展只是 NVIDIA 与每个前沿模型公司协作的全新例证——NVIDIA 不仅旨在于内部加速使用 AI 智能体,也致力于帮助合作伙伴为所有人构建性能卓越、经济高效且低功耗的模型。

正如 NVIDIA 创始人兼首席执行官黄仁勋在一封敦促全体员工使用 Codex 的内部邮件中所表示:“让我们以光速前进。欢迎来到 AI 时代。”

专为企业安全构建的部署

和人类一样,每个智能体都需要自己专属的计算机。

为确保在安全的企业环境中实现无缝运行,Codex 应用支持通过远程 Secure Shell (SSH) 连接到经过批准的云虚拟机,使智能体能使用真实的公司数据,而不将其暴露到外部。

因此,为了确保极高的安全性与可审计性,NVIDIA IT 部门为每位员工推出了云虚拟机 (VM),以便他们安全地运行自己的智能体。这为智能体提供了一个专属沙盒,使其在保持完全可审计性的同时发挥卓越的性能。用户可以通过全体员工都熟悉的用户界面来控制在云虚拟机中运行的 Codex 智能体。

NVIDIA 的部署遵循零数据保留策略,智能体通过命令行界面和 Skills (NVIDIA 在整个公司运行自动化工作流时使用的智能体工具包) 以只读权限访问生产系统。

十年的全栈协作

GPT-5.5 的发布和 Codex 的推出映照了 NVIDIA 和 OpenAI 超过十年的协作成果。双方合作始于 2016 年,当时黄仁勋亲自将首台 NVIDIA DGX-1 AI 超级计算机交付至 OpenAI 位于旧金山的总部。

自此,两家公司在整个 AI 堆栈领域开展了密切合作。

NVIDIA 是 OpenAI gpt-oss 开放权重模型发布的首发合作伙伴,为 NVIDIA TensorRT LLM 和包括 vLLM 和 Ollama 在内的生态系统框架优化模型权重。

OpenAI 承诺为其下一代 AI 基础设施部署超过百亿瓦级的 NVIDIA 系统——这一规模的扩建将使数百万个 NVIDIA GPU 在未来数年成为 OpenAI 模型训练和推理的基础。

OpenAI 和 NVIDIA 是早期芯片与协同设计合作伙伴:OpenAI 提供反馈来为 NVIDIA 的硬件路线图提供参考,并能相应地提前获取新架构的访问权限。这种关系促成了一个坚实的里程碑——完成首个 10 万 GPU 级 NVIDIA Grace Blackwell 机架级扩展系统集群的联合启动。该集群完成了多项大规模训练运行,为前沿规模的系统级可靠性树立了新的基准。

GPT-5.5 正是该基础设施全力运行所带来的成果。如需了解详情,请访问 OpenAI 公告。