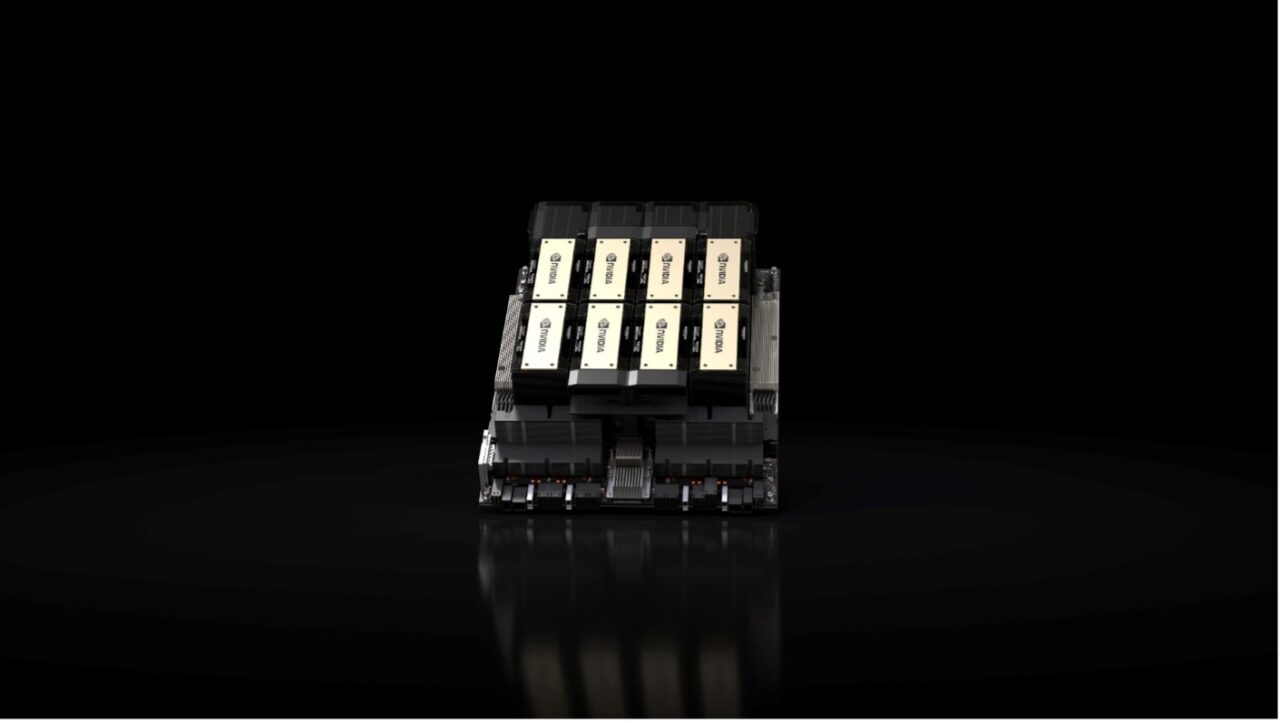

丹佛 – SC23 – 太平洋时间 2023 年 11 月 13 日 – NVIDIA 于今日宣布推出 NVIDIA HGX™ H200,为 Hopper 这一全球领先的 AI 计算平台再添新动力。NVIDIA HGX H200 平台基于 NVIDIA Hopper™ 架构,搭载 NVIDIA H200 Tensor Core GPU 和领先的显存配置,可处理生成式 AI 与高性能计算工作负载的海量数据。

NVIDIA H200 是首款采用 HBM3e 的 GPU,其运行更快、更大的显存容量将进一步加速生成式 AI 与大语言模型,同时推进用于 HPC 工作负载的科学计算。凭借 HBM3e,NVIDIA H200 能够提供传输速度达 4.8 TB/秒的 141GB 显存。与上一代架构的 NVIDIA A100 相比,其容量几乎翻了一倍,带宽也增加了 2.4 倍。

全球领先的服务器制造商和云服务提供商预计于 2024 年第二季度开始提供搭载 H200 的系统。

NVIDIA 超大规模和高性能计算副总裁 Ian Buck 表示:“想要通过生成式 AI 和 HPC 应用创造智能,就必须使用大型、快速的 GPU 显存来高速、高效地处理海量数据。借助 NVIDIA H200,业界领先的端到端 AI 超级计算平台的速度将会变得更快,一些世界上最重要的挑战,都可以被解决。”

持续创新,持续的性能飞跃

与前代架构相比,NVIDIA Hopper 架构实现了前所未有的性能跃升,而 H100 持续的软件升级,包括最近发布的 NVIDIA TensorRT™-LLM 等强大的开源库,都在不断提升其性能标准。

H200 的推出将带来进一步的性能飞跃,比如在一个 700 亿参数的 LLM —— Llama 2 上的推理速度比 H100 提高了近一倍。随着未来软件的持续升级,H200 有望实现更大的性能优势与提升。

NVIDIA H200 的规格

NVIDIA H200 将提供四路和八路 NVIDIA HGX H200 服务器主板可选,其与HGX H100 系统的硬件和软件都兼容。同时还可用于今年 8 月发布的采用 HBM3e 的 NVIDIA GH200 Grace Hopper™ 超级芯片。这些配置使 H200 可以部署在各类数据中心,包括本地、云、混合云和边缘。

在 NVIDIA NVLink™ 和 NVSwitch™ 高速互连技术的加持下,HGX H200 可为各种应用工作负载提供最高的性能,包括针对 1750 亿参数以上超大模型的 LLM 训练和推理。

八路 HGX H200 可提供超过 32 PetaFLOPS的 FP8 深度学习计算能力和 1.1TB 的聚合高带宽内存容量,能够为生成式 AI 和 HPC 应用带来强劲性能。

当H200 与采用超高速 NVLink-C2C 互连技术的 NVIDIA Grace™ CPU 搭配使用时,就组成了带有 HBM3e 的 GH200 Grace Hopper 超级芯片——专为大型 HPC 和 AI 应用而设计的计算模块。

使用 NVIDIA 全栈式软件加速 AI

NVIDIA 加速计算平台具备强大软件工具支持,能够助力开发者和企业构建并加速从 AI 到 HPC 的生产就绪型应用,包括适用于语音、推荐系统和超大规模推理等工作负载的 NVIDIA AI Enterprise 软件套件。

供应情况

NVIDIA H200 将于 2024 年第二季度开始通过全球系统制造商和云服务提供商提供。