Cat 306 CR 小型挖掘机重约八吨,尺寸紧凑,可以装进标准集装箱。当工地空间有限时,例如在建筑物附近挖掘公用设施沟渠或在密集城区挖掘地下室,承包商会租用这种设备。

它的驾驶室空间接近电话亭大小,操作员需要身体靠近控制台,双手各握两个操纵杆。这套系统具有一定的学习门槛。

在今年初的 CES 展会上,这款机器已经能够回答问题了。

在演示中,Cat AI Assistant 运行在 NVIDIA Jetson Thor 平台上。该平台是一个为工业和机器人系统设计的实时推理边缘 AI 平台。为了实现快速准确的自然语音交互,该系统采用了 NVIDIA Nemotron 语音模型,同时借助 Qwen3 4B,可以通过 vLLM 本地服务,确保无云连接的情况下,以低延迟解析请求并生成响应。

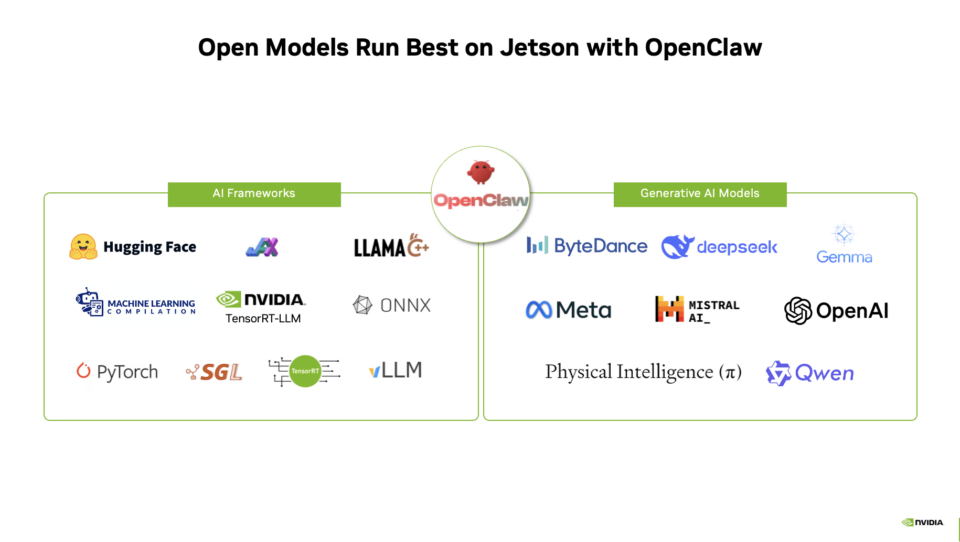

除了推动企业创新,开放模型还为开发者开辟了自由构建与实验的广阔空间。通过在 NVIDIA Jetson 上运行 OpenClaw,开发者可打造个人全天候在线的边缘 AI 助手。不仅能零成本调用 API,还能确保完整的数据隐私。

所有 Jetson 开发套件均支持 OpenClaw,用户能够灵活切换 20 亿至 300 亿参数规模的开放模型。凭借本地运行的前沿级 AI 助手,用户可实时处理晨间简报、自动化日常任务、进行代码审查并控制智能家居系统——全部在本地实时完成。

从云端到边缘

在过去一段时间,开放模型通常部署在最容易提供支持的环境中。

它们运行在数据中心,依赖弹性计算和持续稳定的网络连接提供支撑。然而,云部署会带来延迟成本和持续的计算成本,且这些成本会随着每次查询线性增长。

而物理系统的优化重点则不同。它们需要低延迟,因为机器必须与人和环境实时互动;需要功耗受控,以适应设备的硬件限制;以及稳定一致的行为,因为任何不确定性都会带来风险。

此外,还存在供应层面的问题。内存短缺推高了全行业的成本。Jetson 通过将计算单元与内存集成于单个系统级模块 (SoM) 中,不仅加速了客户的硬件设计进程,也使元器件采购与验证比采用分立方案更为高效可靠。

与此同时,随着模型效率不断提升,开发者也开始提出一个更本质的问题:不再纠结“哪个模型单独性能最强”,而是思考“它在哪里运行才最合理”。

如今,答案越来越明确地指向设备端。例如,入门级生成式 AI 模型可从 Jetson Orin Nano 8GB 起步。

大规模构建自主物理 AI 系统

对物理AI系统而言,生成式 AI 模型正在显著拓展能力边界。

卡特彼勒正在开发的驾驶舱内 Cat AI 助手,可在本地同时运行语音与语言模型,并结合可信的机器上下文,为操作员提供指导与安全辅助功能。

在 CES 上,Franka Robotics 展示了这一理念在机器人领域的实际应用:该公司 FR3 Duo 双臂系统在设备上端到端运行 NVIDIA GR00T N1.6 模型,从环境感知到动作执行,全程无需任务脚本。控制策略完全在本地运行。

在机器人研究领域,NVIDIA GEAR 实验室的 SONIC 项目利用超过 1 亿帧的动作捕捉数据训练人形机器人控制器,随后将所得策略部署到实体机器人上。其中,运动学规划器在 Jetson Orin 上运行,单次推理仅需约 12 毫秒,策略控制环路以 50 Hz 频率稳定运行。所有计算均在设备本地完成。

这一范式也延伸至开发者社区。来自伊利诺伊大学香槟分校 (UIUC) SIGRobotics 社团的一支团队,借助在 Jetson Thor 上运行的 GR00T N1.5 模型,打造了一台双臂抹茶制作机器人,并在 NVIDIA 具身 AI 黑客松中荣获第一名。

纽约大学机器人与具身智能中心也在持续推动这一方向的研究。该团队近期在 Jetson Thor 上运行其 YOR 机器人,借助 NVIDIA Blackwell 架构的强大算力处理 AI 驱动运动所需的复杂计算任务。初步结果显示,YOR 能够执行精细的抓取与放置任务,在面对新物体和场景变化时展现出更强的泛化能力与稳定性,从而加速其在烹饪、洗衣等家庭场景中的应用进程。

独立研究者也得出了相似结论。Hugging Face 多模态研究负责人 Andrés Marafioti 在Jetson AGX Orin 上构建了一个代理式 AI 系统,能够跨模型调度任务并自主安排工作流。某天深夜,该智能体给他发了一条消息:“去睡觉吧,一切明早都会准备好。”

Collabnix 社区的开发者 Ajeet Singh Raina 展示了如何在 NVIDIA Jetson Thor 上运行 OpenClaw,打造一个全天候运行的个人 AI 助手。该配置支持用户对其自有数据进行私有化的大语言模型推理,同时通过本地网关管理电子邮件和日历。

Jetson 正成为新标准

NVIDIA Jetson 已成为在边缘端运行开放模型的通用平台。

它全面支持各类开放模型与 AI 框架,开发者可在边缘端灵活部署几乎任何生成式 AI 工作负载。

模型基准测试可在 Jetson AI Lab 获取,也可查看开放模型社区提供的详细教程。Jetson Thor 在所有主流生成式 AI 模型上均提供领先的推理性能。

Gemma:基于 Google Gemini 研究成果打造,Gemma 3 是 Jetson 平台上的一款多功能主力模型。它原生支持多模态,意味着能“看”并“说”超过 140 种语言。在 Jetson Thor 上,它可处理高达 128K 的上下文窗口,非常适合需要记忆一长串复杂或多步骤指令的机器人应用。

gpt-oss-20B:这款来自 OpenAI 的模型通过在 Jetson Thor 和 Orin 上本地运行,即可提供接近顶尖水平的推理性能,显著降低了先进 AI 的部署门槛,实现高性价比推理。

Mistral AI:全新的 Mistral 3 开放模型系列为开发者和企业提供了业界领先的准确性、效率与定制能力。该系列包含从 3B 到 14B 参数的小型密集模型,体积小巧却异常智能。Jetson 开发者可使用 NVIDIA Jetson Thor 上的 vLLM 容器,在单并发场景下实现每秒 52 个 token 的生成速度,在八并发时可达每秒 273 个 token。

NVIDIA Cosmos:该领先开放推理视觉语言模型,使机器人和 AI 智能体能够像人类一样在物理世界中看见、理解并行动。其 8B 和 2B 版本均可在 Jetson 上高效运行,提供先进的时空感知与推理能力。

NVIDIA Isaac GR00T N1.6:一款面向通用机器人技能的开放视觉语言动作模型 (VLA)。开发者可用它构建能感知环境、理解指令并在多种任务、环境和机器人形态中执行动作的机器人。在 Jetson Thor 上,完整的 GR00T N1.6 管线可在设备端本地运行,实现实时感知、空间理解与快速响应。

NVIDIA Nemotron:一套包含开放模型、数据集与技术组合,赋能用户构建高效、精准、专用的代理式 AI 系统,面向先进推理、编程、视觉理解、代理式任务、安全性、语音与信息处理等场景。Nemotron 3 Nano 9B 模型可在 Jetson Orin Nano Super 上基于 llama.cpp 高效运行,性能达每秒处理 9 个 token。

PI 0.5: Physical Intelligence 推出的 VLA 模型,使机器人能理解指令,并凭借强大的泛化能力与实时适应性,自主执行复杂的现实世界任务。NVIDIA Jetson Thor 可提供每秒 120 个动作 token 的输出,为低延迟、高响应性的物理 AI 部署提供强劲支持。

Qwen 3.5:阿里巴巴推出的系列模型 (包括最新 Qwen 3.5 版本),涵盖密集模型与混合专家 (MoE) 模型,在推理、编程、多模态理解和长上下文处理方面表现卓越。Jetson Thor 为千问系列模型提供了了优化性能,例如 Qwen 3.5-35B-A3B 模型可实现每秒处理 35 个 token 的推理速度,使实时交互成为可能。

任何开发者均可对这些模型进行微调,构建专用的物理 AI 智能体,并将其无缝部署到物理 AI 系统中。NVIDIA Jetson 平台全面支持 NVIDIA TRT、Llama.cpp、Ollama、vLLM、SGLang 等主流 AI 框架。

在 Jetson 上尝试部署开放模型

开发者可学习 Hugging Face 上的教程,例如《在Jetson 上部署开源视觉语言模型》,并观看最新直播演示。通过该教程,学习如何在 NVIDIA Jetson 上运行 OpenClaw。

欢迎参加 GTC 2026,见证实际运行效果。NVIDIA 将展示开放模型如何从数据中心走向真实世界中的机器,将在“工业自主化的未来”专题讨论会上的深度分享相关洞察。

观看 NVIDIA 创始人兼首席执行官黄仁勋的 GTC 主题演讲,并关注物理 AI、机器人与视觉 AI 相关专场会议。

卡特彼勒技术亮点

- NVIDIA Jetson Thor:面向工业与机器人系统的实时边缘 AI 推理平台

- NVIDIA Riva:采用 Parakeet ASR 与 Magpie TTS 的语音 AI 框架

- Qwen3 4B:用于意图解析与生成回复的轻量级大语言模型

- vLLM:在边缘端实现高效 LLM 推理服务的运行时间

- CatHelios:提供可信的设备上下文统一数据平台

- NVIDIA Omniverse:面向工业工作流的数字孪生与仿真框架