人工智能 (AI) 已迅速成为现代计算中最重要的工作负载之一。

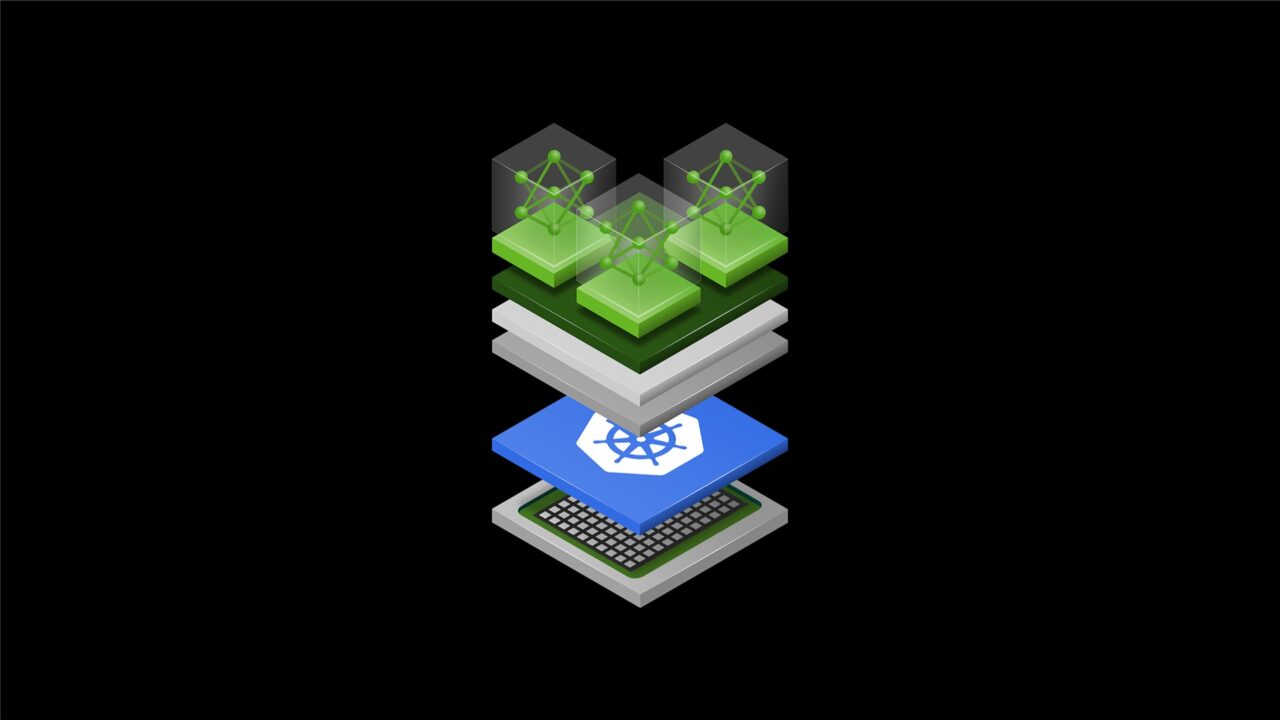

对于绝大多数企业来说,AI 工作负载在 Kubernetes 上运行——一个可实现容器化应用的部署、扩缩容与管理自动化的开源平台。

为了使全球开发者社区能够更高效透明地管理高性能 AI 基础设施,NVIDIA 将向云原生计算基金会 (Cloud Native Computing Foundation, CNCF) 捐赠关键软件——NVIDIA 动态资源分配 (DRA) GPU 驱动程序。CNCF 是一个供应商中立组织,致力于促进和维护云原生生态系统。

该捐赠消息于本周在阿姆斯特丹举行的 CNCF 年度盛会 KubeCon Europe 上发布,此举标志着驱动程序从供应商管理转向 Kubernetes 项目治理,社区拥有完整的所有权。这种开放的环境鼓励更多的专家参与贡献想法,加速创新,并助力确保技术与现代云环境适配。

CNCF 首席技术官 Chris Aniszczyk 表示:“NVIDIA 与 Kubernetes 和 CNCF 社区深度合作,将 NVIDIA DRA GPU 驱动程序贡献至上游,是开源 Kubernetes 和 AI 基础设施的一个重要里程碑。通过将硬件创新与上游 Kubernetes 和 AI 兼容性工作相结合,NVIDIA 让高性能 GPU 编排工作更为无缝,且便于开发者使用。”

此外,NVIDIA 与 CNCF 的机密容器 (Confidential Containers) 社区合作,为 Kata Containers 引入了 GPU 支持,其为一种兼具容器特性的轻量级虚拟机。这将硬件加速扩展到更强大的隔离环境,通过工作负载分离以提高安全性,并使 AI 工作负载能够在更强的保护机制下运行,组织由此可以轻松实施机密计算来保护数据。

简化 AI 基础设施

在过去,管理数据中心内为 AI 提供动力的强大 GPU 需要付出巨大努力。

这一贡献旨在使高性能计算更易于使用。开发者的受益点包括:

- 提高效率:该驱动程序支持 NVIDIA Multi-Process Service 和 NVIDIA Multi-Instance GPU 技术,可实现更智能的 GPU 资源共享,从而有效利用计算能力。

- 大规模扩展:提供原生支持,可将系统连接在一起,兼容 NVIDIA 多节点 NVLink 互联技术。这对于在 NVIDIA Grace Blackwell 系统和下一代 AI 基础设施上训练大型 AI 模型至关重要。

- 灵活性:开发者可以根据需要动态重新配置硬件,随时更改资源分配方式。

- 精度:该软件支持微调请求,允许用户根据其应用需求指定特定的算力、显存设置或互连配置。

全行业协作

NVIDIA 正在与行业领导者合作,包括亚马逊云科技、博通、Canonical、Google Cloud、微软、Nutanix、红帽和 SUSE,共同推动这些功能的发展,造福整个云原生生态系统。

红帽首席技术官兼全球工程高级副总裁 Chris Wright 表示:“开源将成为每个成功企业 AI 策略的核心,为推动生产级 AI 工作负载的高性能基础设施组件带来标准化。NVIDIA 捐赠的 NVIDIA DRA GPU 驱动程序有助于巩固开源在 AI 演进中的作用,我们期待与 NVIDIA 以及 Kubernetes 生态系统中更广泛的社区展开合作。”

CERN 平台基础设施负责人 Ricardo Rocha 表示:“开源软件及其背后维系的社区是科学计算和研究基础设施的基石。对于 CERN 这样需要高效分析 PB 级数据来实现科研突破的组织来说,社区驱动的创新有助于加快科学发展步伐。NVIDIA 捐赠的 DRA 驱动程序强化了研究人员所依赖的生态系统,使他们能够同时处理传统科学计算和新兴机器学习工作负载中的数据。”

扩展开源视野

这一项捐赠只是 NVIDIA 支持开源社区的更广泛举措的一部分。其他举措还包括在上周 GTC 大会上发布的 NVSentinel (GPU 故障修复系统) 以及 AI Cluster Runtime (智能体 AI 框架)。

此外,NVIDIA 还于 GTC 大会宣布了全新开源项目,包括 NVIDIA NemoClaw 参考软件栈以及 NVIDIA OpenShell 运行时,用于安全运行自主智能体。OpenShell 支持细粒度可编程策略安全性和隐私管理,并与 Linux、eBPF 和 Kubernetes 原生集成。

NVIDIA 还宣布,其高性能 AI 工作负载调度器 KAI Scheduler 已作为 CNCF Sandbox 项目上线,这是朝着促进更广泛的协作并确保技术与更广泛的云原生生态系统需求同步发展迈出的关键一步。开发者和企业组织可以立即使用 KAI Scheduler 并提出建议。

NVIDIA 致力于积极维护和贡献 Kubernetes 及 CNCF 项目,助力满足企业 AI 客户的严格需求。

此外,在 NVIDIA Dynamo 1.0 发布后,NVIDIA 正在借助 Grove 扩展 Dynamo 生态系统,Grove 是一个用于在 GPU 集群上编排 AI 工作负载的开源 Kubernetes 应用编程接口。Grove 能够使开发者在单一声明式资源中表达复杂的推理系统,目前正在与 llm-d 推理堆栈集成,以便在 Kubernetes 社区中得到更广泛的采用。

开发者和企业组织可以开始使用 NVIDIA DRA 驱动程序。

于 KubeCon 上的 NVIDIA 展位观看这项技术的现场演示。